OpenAI прагне відмовитися від провідного бенчмарку для оцінки кодування ШІ — причини викривають глибинну проблему в методах самооцінки індустрії.

Створіть обліковий запис, щоб зберегти свої статті.Додати в GoogleДодайте Decrypt як джерело за вибором, щоб бачити більше наших історій у Google.

Ключові моменти

- OpenAI стверджує, що SWE-bench Verified більше не відображає реальні навички програмування через нібито “зараження” даних для тестування.

- Компанія просуває SWE-bench Pro як складнішу альтернативу.

- За новими тестами показники впали з ~70% до ~23%.

Цифра, яку використовували провідні лабораторії ШІ для підтвердження своєї переваги у сфері програмування, була оголошена безглуздою.

OpenAI опублікувала цього тижня повідомлення, в якому зазначено, що SWE-bench Verified, основний бенчмарк для оцінки навичок програмування ШІ, настільки перенасичений невірними тестами та витоком даних для навчання, що більше не надає корисної інформації про здатність моделі писати програмний код.

Принцип роботи бенчмарку наступний: ШІ отримує реальну проблему з GitHub з популярного проєкту з відкритим кодом, йому пропонується виправити помилку без доступу до тестів, а потім перевіряється, чи виправлення проходить збійні тести, не порушуючи інший функціонал.

OpenAI створила SWE-bench Verified у серпні 2024 року як покращену версію оригінального бенчмарку 2023 року, залучивши 93 інженерів-програмістів для фільтрації завдань, які були неможливими або погано розробленими.

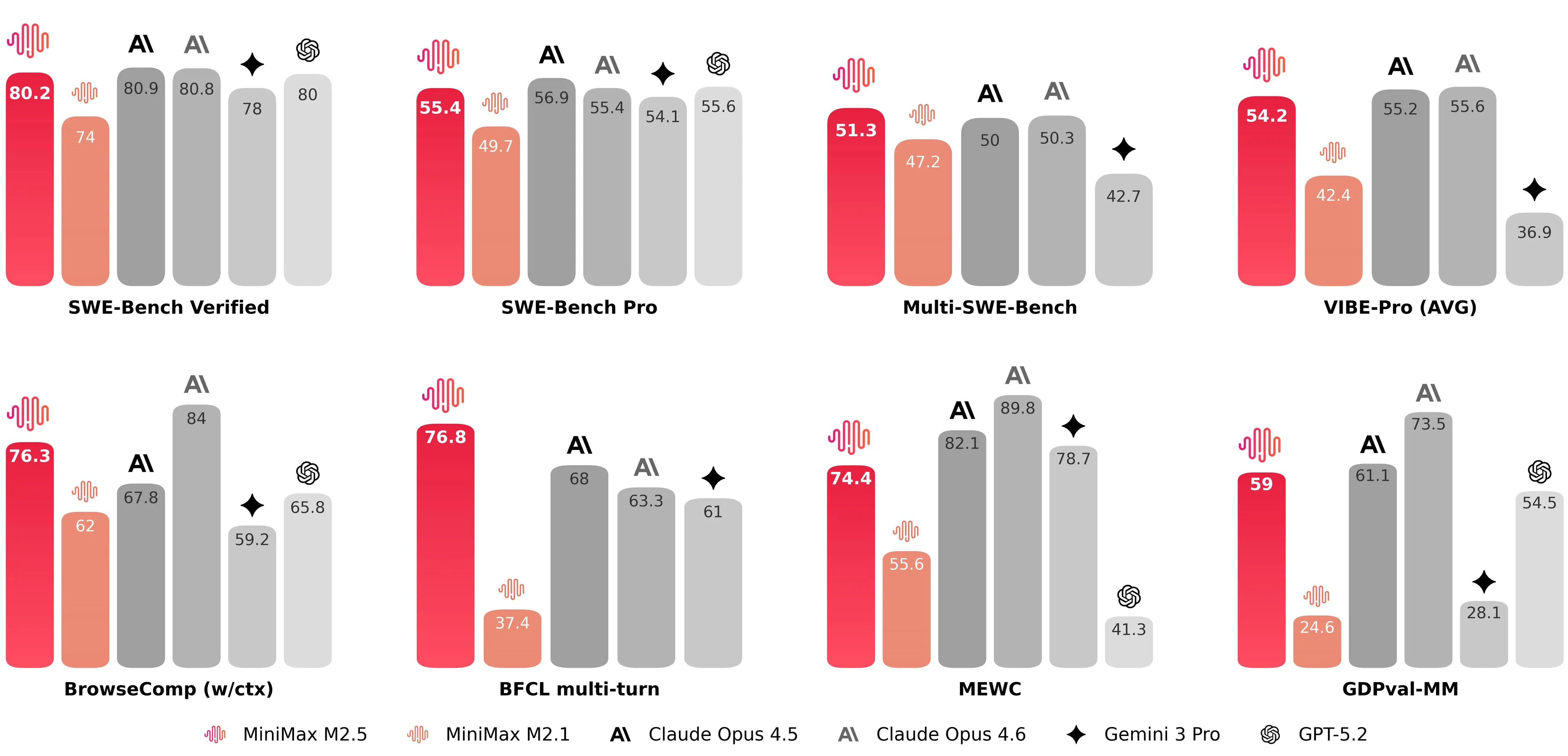

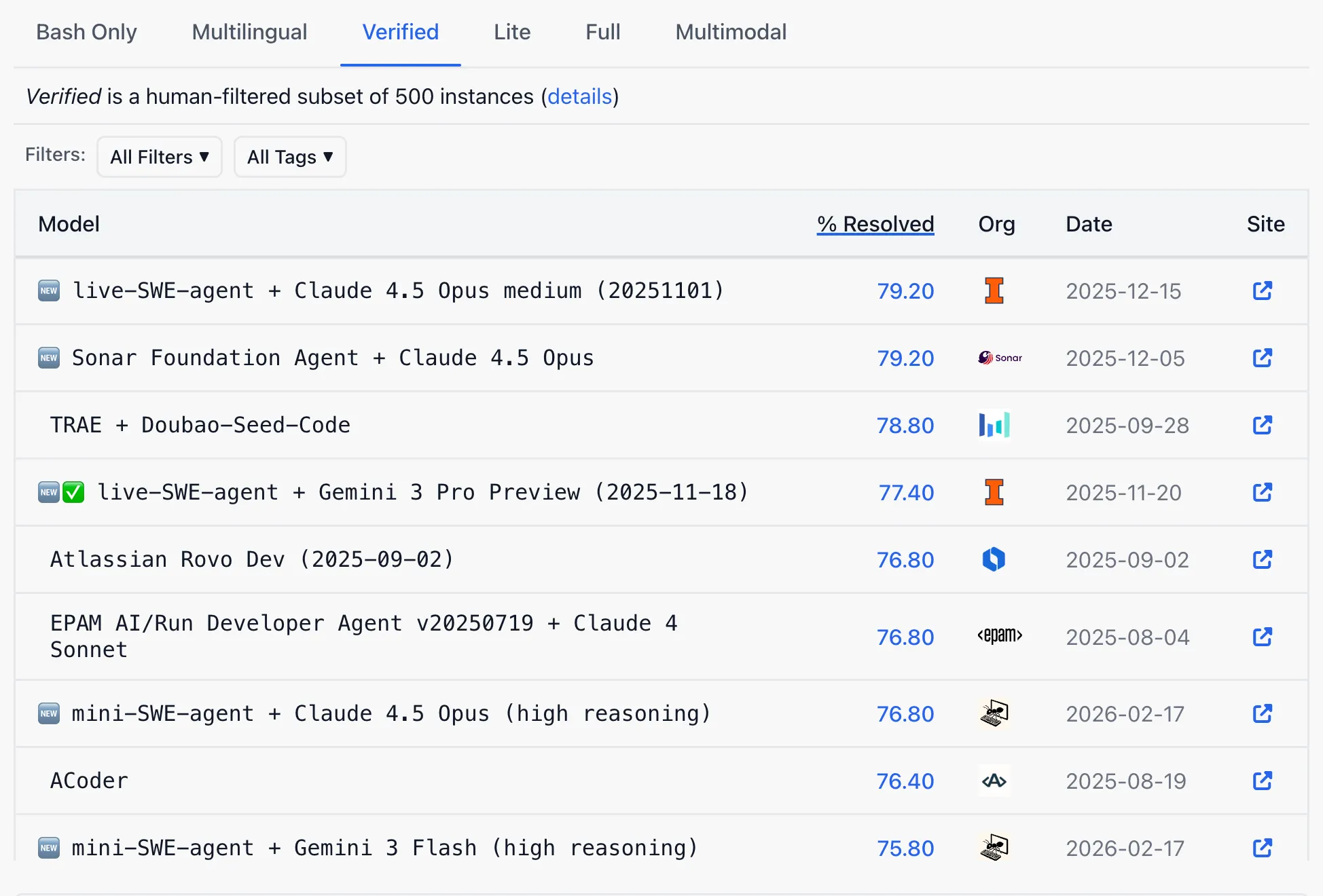

Покращення виявилося настільки ефективним, що кожна провідна лабораторія почала цитувати результати на ньому як доказ прогресу. Коли Anthropic запустила Claude Opus 4 у травні 2025 року, Decrypt повідомляв, що модель показала 72,5% на SWE-bench Verified, випередивши GPT-4.1 (54,6%) та Gemini 2.5 Pro (63,2%). Це був той бенчмарк для кодування, який мав значення.

З того часу кожна лабораторія ШІ, від Америки до Китаю, використовувала показники SWE, щоб претендувати на звання найкращої моделі за можливостями програмування.

Тепер OpenAI стверджує, що ця гонка була частково ілюзією. Згідно зі звітом, команда проаналізувала 138 завдань, які GPT-5.2 послідовно провалив протягом 64 незалежних прогонів, і шість інженерів переглянули кожне. Врешті-решт, було зроблено висновок, що 59,4% цих завдань є некоректними.

Приблизно 35,5% мають надто вузько написані тести, які вимагають специфічної назви функції, яка ніколи не згадувалася в описі проблеми. Ще 18,8% перевіряють функції, які взагалі не були частиною початкової проблеми, а були взяті з непов’язаних запитів на злиття (pull requests).

Проблема “зараження” даних працює приблизно так: SWE-bench використовує проблеми з репозиторіїв з відкритим кодом, які більшість компаній, що займаються ШІ, сканують під час створення наборів даних для навчання. OpenAI перевірила, чи бачили GPT-5.2, Claude Opus 4.5 та Gemini 3 Flash Preview рішення бенчмарку під час навчання. Всі три моделі мали доступ до цих даних.

Отримавши лише ідентифікатор завдання та коротку підказку, кожна модель могла відтворити точне виправлення коду з пам’яті, включаючи назви змінних та коментарі в коді, які не з’являлися в описі проблеми. В одному випадку журнали ланцюжка думок (chain-of-thought) GPT-5.2 показали, що модель припускала, що певний параметр був “доданий навколо Django 4.1” — деталі, знайдені лише в примітках до випуску Django, а не в описі завдання. Модель відповідала на запитання, відповідь на яке вона вже бачила.

OpenAI тепер рекомендує SWE-bench Pro, новіший бенчмарк від Scale AI, який використовує більш різноманітні кодові бази та ліцензії, що зменшують ймовірність доступу до даних навчання. Падіння продуктивності вражаюче: моделі, які показали понад 70% на старому бенчмарку Verified, демонструють близько 23% на публічному розділі SWE-bench Pro і ще менше на його приватних завданнях.

У поточному публічному лідерборді SWE-bench Verified OpenAI далеко не на перших позиціях. Відмова від бенчмарку, де компанія програє, та просування того, де всі починають з 23%, зручно скидає табло та робить заяви конкурентів менш вражаючими.

Це особливо важливо, враховуючи, що нова версія DeepSeek, яка очікується, за чутками, перевершить або наблизиться до американських ШІ-моделей, особливо в завданнях, пов’язаних з агентами та кодуванням, з безкоштовною моделлю з відкритим кодом. Ця модель може бути випущена за кілька днів, і SWE-bench Verified може стати ключовим показником для оцінки її якості.

OpenAI заявила, що розробляє власні приватні оцінки, які не будуть опубліковані до тестування, вказуючи на свій проєкт GDPVal, де експерти в певних галузях створюють оригінальні завдання, що оцінюються навченими рецензентами.

Проблема бенчмарків не нова і не унікальна для програмування. Лабораторії ШІ переходили від одних оцінок до інших, кожна з яких була корисною доти, доки моделі не були навчені на них, або доки завдання не виявлялися занадто вузькими.

Проте, що робить цей випадок видатним, так це те, що OpenAI активно просувала SWE-bench Verified, рекламувала його під час випусків моделей, а тепер публічно документує, наскільки він зазнав краху — навіть демонструючи, як власна модель компанії “шахраювала” на ньому.

Погляд Crypto Top: Відмова від перенасичених бенчмарків та перехід до більш надійних систем оцінки ШІ-можливостей матиме значний вплив на сприйняття продуктивності ШІ в Web3, потенційно змінюючи траєкторію розвитку децентралізованих ШІ-протоколів та їхніх нативних токенів.

Джерело: decrypt.co