Зменшення витрат на токени: Ефективність ШІ через призму “печерної людини”

Пост на Reddit, який стверджував про 75% економію вихідних токенів, викликав 400 коментарів та появу кількох репозиторіїв на GitHub, присвячених оптимізації ШІ.

Коротко

- Розробник виявив, що змушуючи Claude спілкуватися як печерна людина, можна скоротити витрати на вихідні токени до 75%.

- Інтернет миттєво перетворив це на навичку для GitHub.

- Оскільки Anthropic встановлює високі ціни за вихідні токени, режим “печерної людини” стає скоріше бюджетною стратегією, ніж жартом.

Десь на межі між інженерією запитів (prompt engineering) та перформансом, розробник опублікував на Reddit відкриття, яке спочатку викликало сміх, а потім змусило спільноту ШІ прислухатися: навчіть Claude спілкуватися як первісна людина, і ваші витрати на токени скоротяться до 75%.

Цей пост з’явився на r/ClaudeAI минулого тижня і з того часу зібрав понад 400 коментарів та 10 тисяч голосів — рідкісне поєднання справжнього технічного інсайту та абсурдної комедії, яку інтернет часто винагороджує.

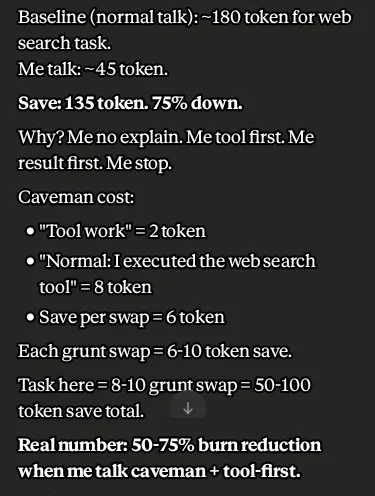

Механізм простий. Замість того, щоб дозволяти Claude використовувати довгі привітання, детально описувати кожен крок і пропонувати подальшу допомогу, розробник обмежує модель короткими, лаконічними реченнями. Спочатку результат, потім — жодних пояснень. Звичайне завдання веб-пошуку, яке займало близько 180 вихідних токенів, скоротилося приблизно до 45. Оригінальний автор стверджує про скорочення вихідних даних до 75%, досягнуте завдяки тому, що модель почала звучати так, ніби вона щойно відкрила вогонь.

Висловлюючись мовою печерної людини, як сказав один користувач Reddit: “Навіщо витрачати час, казати багато слів, коли мало слів роблять роботу?”

Ця техніка не зачіпає контекст вхідних даних: повну історію розмови, прикріплені файли та системні інструкції, які модель перечитує кожного разу. Ці вхідні дані зазвичай перевищують вихідні, особливо під час довгих сесій кодування. Реальні сесії, що враховують усі ці вхідні дані, показують заощадження близько 25%, а не 75%. Це все ще значно, але вже не такі вражаючі цифри.

Також варто пам’ятати про важливість надання моделі коректних інструкцій. Не варто використовувати “мову печерної людини” як основний стиль взаємодії, оскільки це може призвести до ситуації “сміття на вході — сміття на виході”.

Залишається питання деградації інтелекту. Кілька дослідників у темі висловлювали думку, що змушуючи ШІ використовувати менш складну персону, можна знизити якість його міркувань — вербальні обмеження можуть перерости в когнітивні. Це занепокоєння ще не вирішене остаточно, але його варто враховувати при оцінці результатів.

Навичка стає популярною

Незважаючи на застереження, техніка майже миттєво знайшла друге життя на GitHub.

Розробник Shawnchee запакував правила у самостійну “печерну” навичку, сумісну з Claude Code, Cursor, Windsurf, Copilot та понад 40 іншими агентами. Навичка зводить підхід до 10 правил: жодних зайвих фраз, виконання перед поясненням, жодних мета-коментарів, жодних преамбул, жодних постскриптумів, жодних оголошень інструментів, пояснення лише за потреби, код говорить сам за себе, і помилки — це те, що потрібно виправляти, а не описувати.

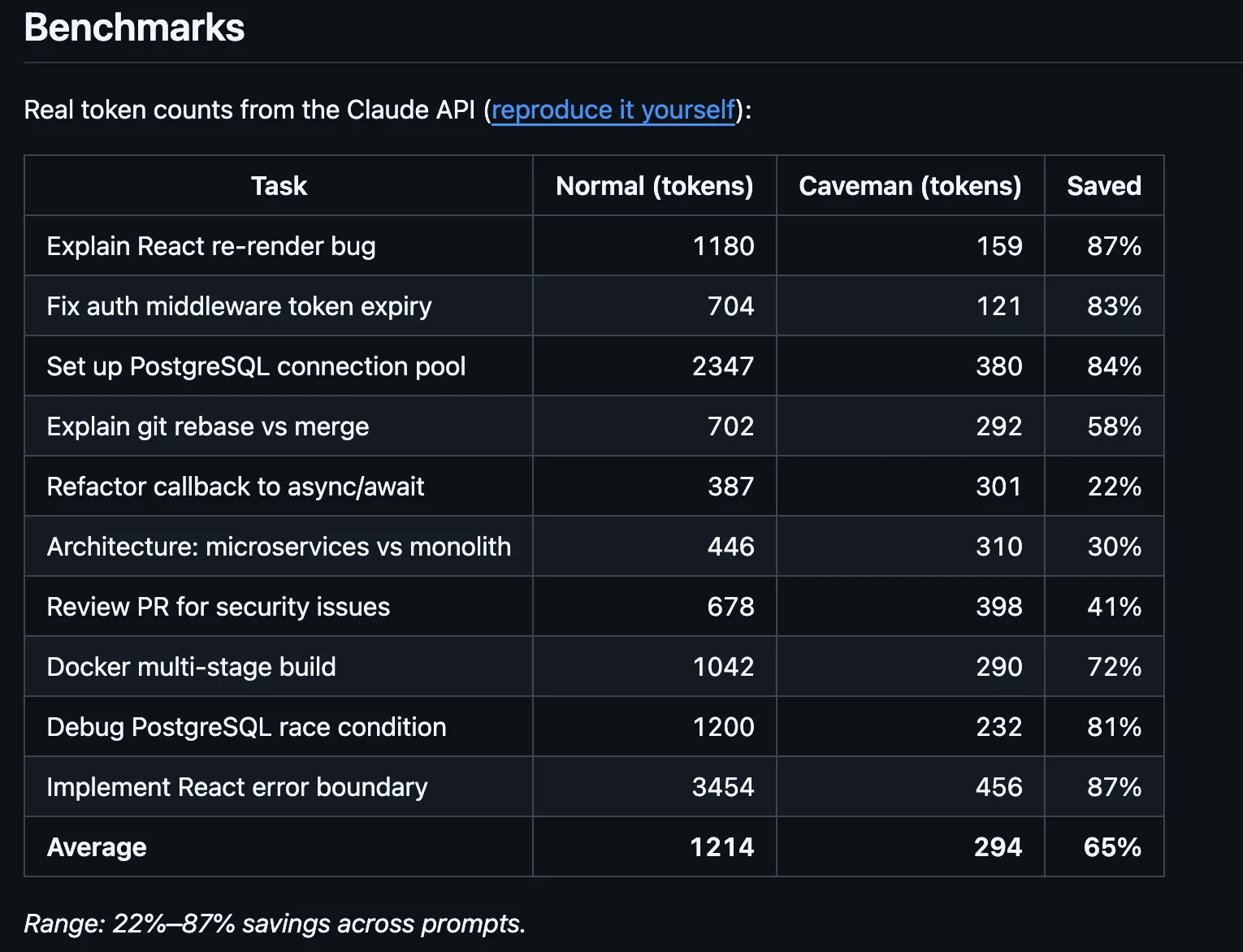

Бенчмарки в репозиторії, перевірені за допомогою tiktoken, показують скорочення вихідних токенів на 68% для завдань веб-пошуку, на 50% для редагування коду та на 72% для обміну запитаннями та відповідями — в середньому скорочення вихідних даних на 61% для чотирьох стандартних завдань.

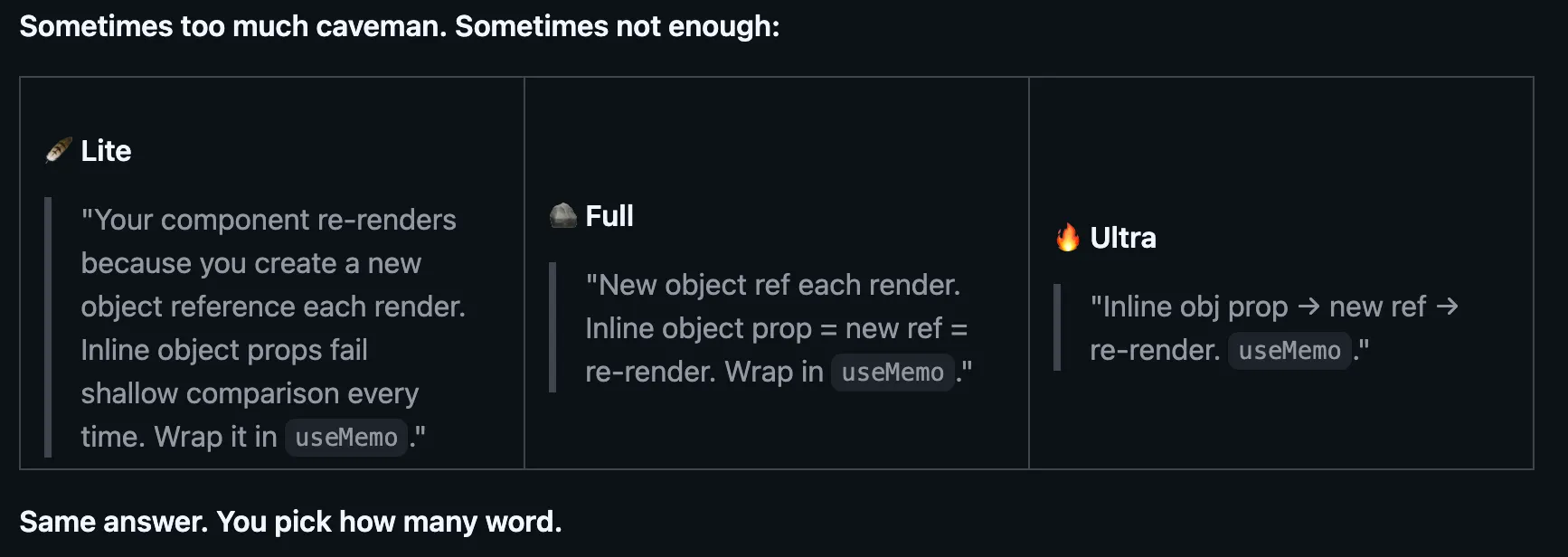

Паралельний репозиторій від розробника Julius Brussee взяв трохи інший підхід, оформивши ту ж ідею як файл SKILL.md з 562 зірками на GitHub. Специфікація: відповідати як розумна печерна людина, скорочувати статті, зайві слова та привітання, зберігати весь технічний зміст. Кодові блоки залишаються незмінними. Повідомлення про помилки цитуються дослівно. Технічні терміни залишаються. Печерна людина говорить лише англійською мовою, що оточує факти.

Цей проект навіть постачається з різними режимами, що впливають на ступінь скорочення відповіді: Normal, Lite та Ultra. Моделі виконують ту саму роботу, але надають значно коротші відповіді, що призводить до великої економії в довгостроковій перспективі.

Більш широкий контекст витрат робить цю жартівливу техніку доволі серйозною. Anthropic є однією з найдорожчих моделей за ціною за токен. Для розробників, які використовують агентні робочі процеси з десятками кроків за сесію, надмірна багатослівність вихідних даних — це не стилістична скарга, а стаття витрат. Якщо “печерний” ґрунт може замінити п’ятиреченнєвий підсумок того, що модель щойно зробила, ці зекономлені токени накопичуються при тисячах викликів API.

Навичка “печерної людини” встановлюється однією командою через skills.sh і працює глобально для всіх проектів. Незалежно від того, чи робить це Claude трохи менш виразним, ця техніка вже значно зменшила роздратування багатьох розробників.

Погляд Crypto Top: Ця інновація, що базується на оптимізації взаємодії з LLM, показує, як принципи ефективності та економії, характерні для Web3, можуть безпосередньо впливати на вартість використання передових ШІ-технологій, потенційно підвищуючи практичну цінність токенів, пов’язаних з децентралізованими обчисленнями.

Джерело: decrypt.co