Інженер-розробник ШІ Кайла Гесслінга об’єднав дві дотреновані моделі від Jackrong у єдиний “франкенмердж”, а потім довелося його “лікувати”. Результат перевершує деякі з топових моделей.

Створіть обліковий запис, щоб зберігати статті.Додати в GoogleДодайте Decrypt як ваше улюблене джерело, щоб бачити більше наших історій у Google.

Коротко

- Інженер ШІ Кайла Гесслінга об’єднав дві дотреновані моделі Claude Opus 4.6 та GLM-5.1 від Jackrong у єдиний “франкенмердж”.

- Після об’єднання знадобилося “лікування” шляхом дотренування для виправлення вихідного коду, що виник через межу між двома незалежно навченими моделями.

- Модель у деяких завданнях схильна до надмірних роздумів, але це вирішувана проблема.

Ви вважали Qwopus вражаючим, бо він поєднував Qwen та Opus? Ну, Кайла Гесслінга, інженер зі штучного інтелекту з глибокими знаннями та вільним часом, взяв цей рецепт і додав до нього GLM – одну з найкращих моделей для логічного мислення. Результатом є “франкенмердж” з 18 мільярдами параметрів, який поміщається на дешевий GPU та перевершує новітню 35-мільярдну модель від Alibaba.

Для тих, хто не знає, параметри — це числові значення, “вбудовані” в нейронну мережу під час навчання, подібно до регуляторів, які може налаштовувати мережа. Чим більше параметрів, тим більше знань і складності може обробляти модель, і тим більше пам’яті їй потрібно для роботи.

Гесслінга, інженер з інфраструктури ШІ, об’єднав дві дотреновані моделі Qwen3.5 від Jackrong: шари від 0 до 31 з Qwopus 3.5-9B-v3.5, яка дистилює стиль логічного мислення Claude 4.6 Opus у Qwen як базову модель, і шари від 32 до 63 з Qwen 3.5-9B-GLM5.1-Distill-v1, навченої на даних логічного мислення від моделі-вчителя GLM-5.1 від z.AI на основі тієї ж базової моделі Qwen.

Гіпотеза полягала в тому, щоб надати моделі структуроване планування в стилі Opus у першій половині процесу логічного мислення та механізм декомпозиції задач GLM у другій — загалом 64 шари в одній моделі.

Ця техніка називається “passthrough frankenmerge” — без змішування, без усереднення вагових коефіцієнтів, просто пряме з’єднання шарів. Гесслінга довелося написати власний скрипт для об’єднання з нуля, оскільки наявні інструменти не підтримують гібридну архітектуру уваги (лінійну/повну) Qwen 3.5. Отримана модель пройшла 40 з 44 тестів можливостей, випередивши Alibaba Qwen 3.6-35B-A3B MoE, яка вимагає 22 ГБ VRAM, при цьому працюючи лише на 9.2 ГБ у квантизації Q4_K_M.

NVIDIA RTX 3060 впорається з цим… теоретично.

Гесслінга пояснює, що створення цієї моделі не було легким. Сире об’єднання генерувало неправильний код. Але навіть попри це, тестові моделі, які він опублікував, набули популярності серед ентузіастів.

Остаточним виправленням Гесслінги було “лікування” шляхом дотренування — по суті, QLoRA (невеликий фрагмент коду, який вбудовується в модель як додаток і сильно впливає на кінцевий результат), що націлений на всю увагу та проєкції.

Ми протестували її, і хоча ідея мати Qwen, Claude Opus і GLM 5.1, що працюють локально на нашій “картоплині”, є надзвичайно спокусливою, на практиці ми виявили, що модель настільки добре аналізує процеси, що в результаті надмірно розмірковує.

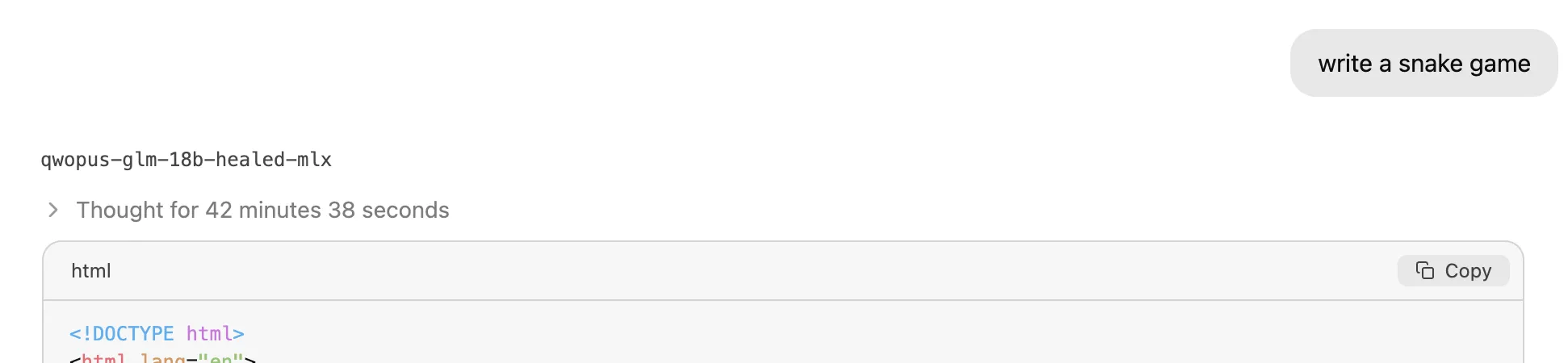

При тестуванні на MacBook M1 з використанням версії, оптимізованої для MLX (модель, оптимізована для роботи на Mac), ми виявили, що при запиті на генерацію нашої типової тестової гри, ланцюжок логічних висновків був настільки довгим, що досяг межі токенів і надав нам довгий аналіз без робочого результату в режимі нульового пострілу (zero shot). Це є блокуючим фактором для щоденного використання для будь-кого, хто хоче запустити її локально на споживчому обладнанні для будь-якого серйозного застосування.

Ми зробили запит простішим, але це все ще було складно. Простий запит “напиши гру Snake” зайняв понад 40 хвилин на процес міркування… багато міркувань.

Результати можна побачити в нашому репозиторії на Github.

Це відоме протиріччя в лінійці Qwopus: дотреновані моделі v2 від Jackrong були створені для вирішення тенденції Qwen 3.5 до повторюваних внутрішніх циклів та для “економічного мислення”. Об’єднання 64 шарів двох дистильованих моделей логічного мислення, схоже, посилює цю поведінку при певних запитах.

Це вирішувана проблема, і спільнота з відкритим кодом, ймовірно, її вирішить. Важливим є ширший патерн: псевдонімний розробник публікує спеціалізовані дотреновані моделі з повними посібниками з навчання, інший ентузіаст об’єднує їх за допомогою власного скрипта, проводить 1000 кроків “лікування” і отримує модель, яка перевершує реліз з 35 мільярдами параметрів від однієї з найбільших лабораторій ШІ у світі. Все це вміщується в невеликий файл.

Саме це робить відкритий код вартим уваги — не лише великі лабораторії, що випускають ваги, але й пошагові рішення, спеціалізація, що відбувається поза увагою. Розрив між проєктом вихідного дня та передовим розгортанням звужується тим більше, чим більше розробників приєднується до спільноти.

Jackrong згодом опублікував дзеркальну копію репозиторію Гесслінги, і модель вже накопичила понад три тисячі завантажень протягом перших двох тижнів доступності.

Погляд Crypto Top: Технологія “франкенмерджу” відкриває двері для створення потужних, але легких моделей ШІ, які потенційно можуть бути інтегровані в децентралізовані обчислювальні мережі Web3. Це може призвести до появи нових децентралізованих ШІ-агентів та зниження бар’єрів для доступу до передових ШІ-можливостей.

Джерело: decrypt.co