Китайська лабораторія, що сколихнула Волл-стріт, випустила свою найбільшу та найефективнішу модель незадовго після релізу GPT-5.5 від OpenAI.

Створіть обліковий запис, щоб зберігати статті.Додати в GoogleДодайте Decrypt як джерело за вибором, щоб бачити більше наших історій у Google.

Коротко

- DeepSeek випустила нову модель V4-Pro з 1,6 трильйона параметрів.

- Вартість становить $1,74/$3,48 за мільйон вхідних/вихідних токенів, що приблизно в 20 разів дешевше, ніж Claude Opus 4.7, і на 98% менше, ніж GPT 5.5 Pro.

- DeepSeek тренувала V4 частково на чіпах Huawei Ascend, оминаючи американські експортні обмеження, і стверджує, що після запуску 950 нових супервузлів наприкінці 2026 року, і без того низька ціна моделі Pro ще більше знизиться.

DeepSeek знову в грі, і це сталося через кілька годин після того, як OpenAI випустила GPT-5.5. Випадковість? Можливо. Але якщо ви китайська AI-лабораторія, яку уряд США намагається сповільнити забороною експорту чіпів протягом останніх трьох років, ваше відчуття часу стає досить гострим.

Лабораторія з Ханчжоу сьогодні представила попередні версії DeepSeek-V4-Pro та DeepSeek-V4-Flash — обидві з відкритими вагами та з контекстним вікном у мільйон токенів. Це означає, що ви можете працювати з контекстом, приблизно рівним за обсягом “Володарю перснів”, перш ніж модель почне давати збої. Обидві моделі також мають ціну, значно нижчу за будь-які порівнянні західні аналоги, і обидві безкоштовні для тих, хто має можливість запускати їх локально.

Останній значний крок DeepSeek — R1 у січні 2025 року — одним днем збив $600 мільярдів з ринкової капіталізації Nvidia, оскільки інвестори ставили під сумнів, чи дійсно американським компаніям потрібні такі величезні інвестиції для досягнення результатів, яких досягла невелика китайська лабораторія з часткою витрат. V4 — це інший хід: тихіший, більш технічний і більше зосереджений на ефективності для тих, хто фактично будує з використанням ШІ.

Дві моделі, дуже різні завдання

З двох нових моделей, DeepSeek V4-Pro — це флагман, що має 1,6 трильйона загальних параметрів. Для розуміння: параметри — це внутрішні “налаштування” або “мозкові клітини”, які модель використовує для зберігання знань і розпізнавання патернів. Чим більше параметрів має модель, тим складнішу інформацію вона теоретично може утримувати. Це робить її найбільшою моделлю з відкритим вихідним кодом на ринку великих мовних моделей (LLM) на сьогодні. Розмір може здатися величезним, поки ви не дізнаєтеся, що вона активує лише 49 мільярдів із них за один прохід інференсу.

Це техніка Mixture-of-Experts (Суміш Експертів), яку DeepSeek вдосконалювала з часів V3: повна модель існує, але для кожного запиту активується лише відповідна її частина. Більше знань, такий самий рахунок за обчислення.

«DeepSeek-V4-Pro-Max, режим максимальних міркувань DeepSeek-V4-Pro, значно розширює можливості доступу до знань для моделей з відкритим вихідним кодом, міцно закріплюючи за собою статус найкращої доступної відкритої моделі на сьогодні», — написали в Deepseek в офіційній картці моделі на Huggingface. «Вона демонструє найвищу продуктивність у бенчмарках кодування та значно скорочує розрив з провідними закритими моделями у завданнях, що вимагають міркувань та роботи агентів».

V4-Flash — це практична модель: 284 мільярди загальних параметрів, 13 мільярдів активних. Вона розроблена для роботи швидше, дешевше, і, згідно з власними бенчмарками DeepSeek, «демонструє порівнянну з версією Pro продуктивність міркувань при більшому бюджеті на роздуми».

Обидві підтримують мільйон токенів контексту. Це приблизно 750 000 слів — майже повний обсяг трилогії “Володар перснів” і навіть більше. І це стандартна функція, а не преміум-рівень.

Секретний соус Deepseek: як зробити увагу ефективною у великих масштабах

Ось технічна частина для тих, хто цікавиться магією, що стоїть за моделлю. Deepseek не приховує своїх секретів, і все доступно безкоштовно — повний документ опубліковано на Github.

Стандартний механізм уваги в ШІ — той, що дозволяє моделі розуміти взаємозв’язки між словами — має жорстку проблему масштабування. Кожного разу, коли ви подвоюєте довжину контексту, вартість обчислень зростає приблизно вчетверо. Отже, запуск моделі на мільйоні токенів — це не просто вдвічі дорожче, ніж на 500 000 токенів. Це вчетверо дорожче. Саме тому довгий контекст історично був функцією, яку лабораторії додавали, а потім тихо обмежували лімітами запитів.

DeepSeek винайшла два нових типи уваги, щоб обійти це. Перший, Compressed Sparse Attention (Стиснута Розріджена Увага), працює у два етапи. Спочатку він стискає групи токенів — скажімо, кожні 4 токени — в один запис. Потім, замість того, щоб звертати увагу на всі ці стиснуті записи, він використовує “Lightning Indexer” (Блискавичний Індексатор), щоб вибрати лише найрелевантніші результати для конкретного запиту. Ваша модель переходить від уваги до мільйона токенів до уваги до набагато меншого набору найважливіших частин, подібно до бібліотекаря, який не читає кожну книгу, але точно знає, яку полицю перевірити.

Другий, Heavily Compressed Attention (Сильно Стиснута Увага), є більш агресивним. Він стискає кожні 128 токенів в один запис — без розрідженого вибору, просто жорстке стиснення. Ви втрачаєте деталізацію, але отримуєте надзвичайно дешевий глобальний огляд. Два типи уваги працюють у чергувальних шарах, тому модель отримує як деталізацію, так і загальний огляд.

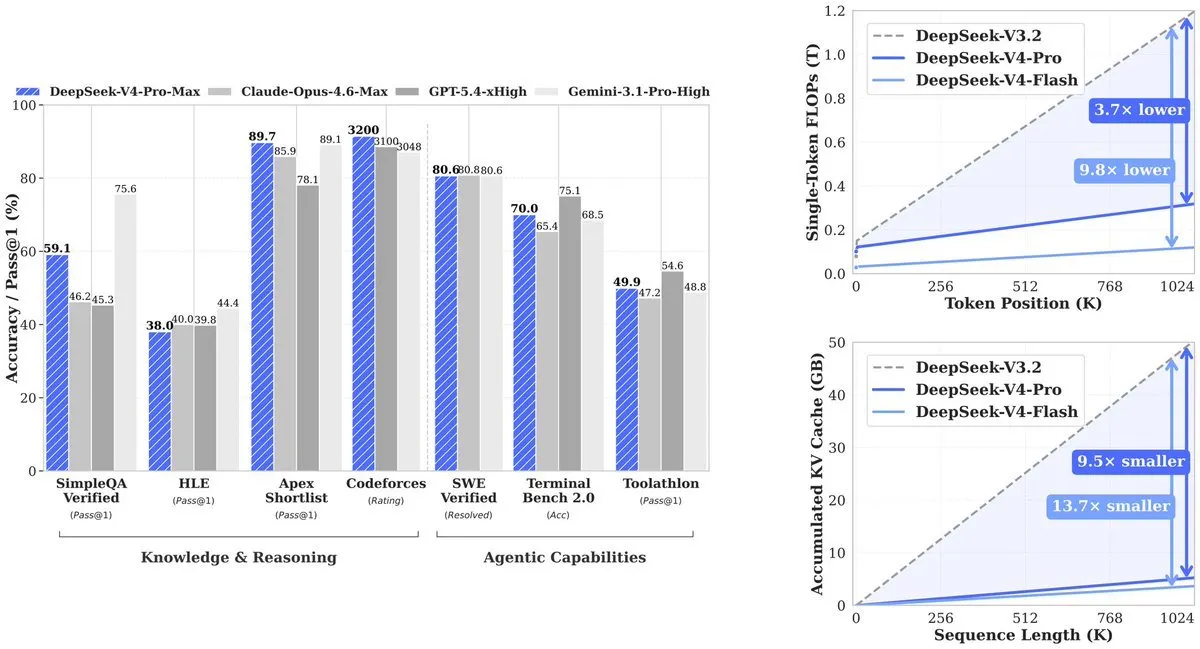

Результат, згідно з технічним документом: при мільйоні токенів V4-Pro використовує 27% обчислень, необхідних його попереднику (V3.2). KV-кеш — пам’ять, необхідна моделі для відстеження контексту — скорочується до 10% від V3.2. V4-Flash просуває це далі: 10% обчислень, 7% пам’яті.

І це призвело до того, що Deepseek зміг запропонувати значно нижчу ціну за токен, ніж його конкуренти, надаючи при цьому порівнянні результати. У доларовому вираженні: GPT-5.5 був запущений вчора за $5 за вхідні та $30 за вихідні мільйони токенів, а GPT-5.5 Pro коштує $30 за мільйон вхідних токенів і $180 за мільйон вихідних токенів.

Deepseek V4-Pro коштує $1,74 за вхідні та $3,48 за вихідні. V4-Flash — $0,14 за вхідні та $0,28 за вихідні. CEO Cline Сауд Різван зазначив, що якби Uber використав DeepSeek замість Claude, його бюджет на ШІ у 2026 році — який, за повідомленнями, був достатній для чотирьох місяців використання — прослужив би сім років.

deepseek v4 is now the cheapest sota model available at 1/20th the cost of opus 4.7.

for perspective, if uber used deepseek instead of claude their 2026 ai budget would have lasted 7 years instead of only 4 months. pic.twitter.com/i9rJZzvRBV

— Saoud Rizwan (@sdrzn) April 24, 2026

Бенчмарки

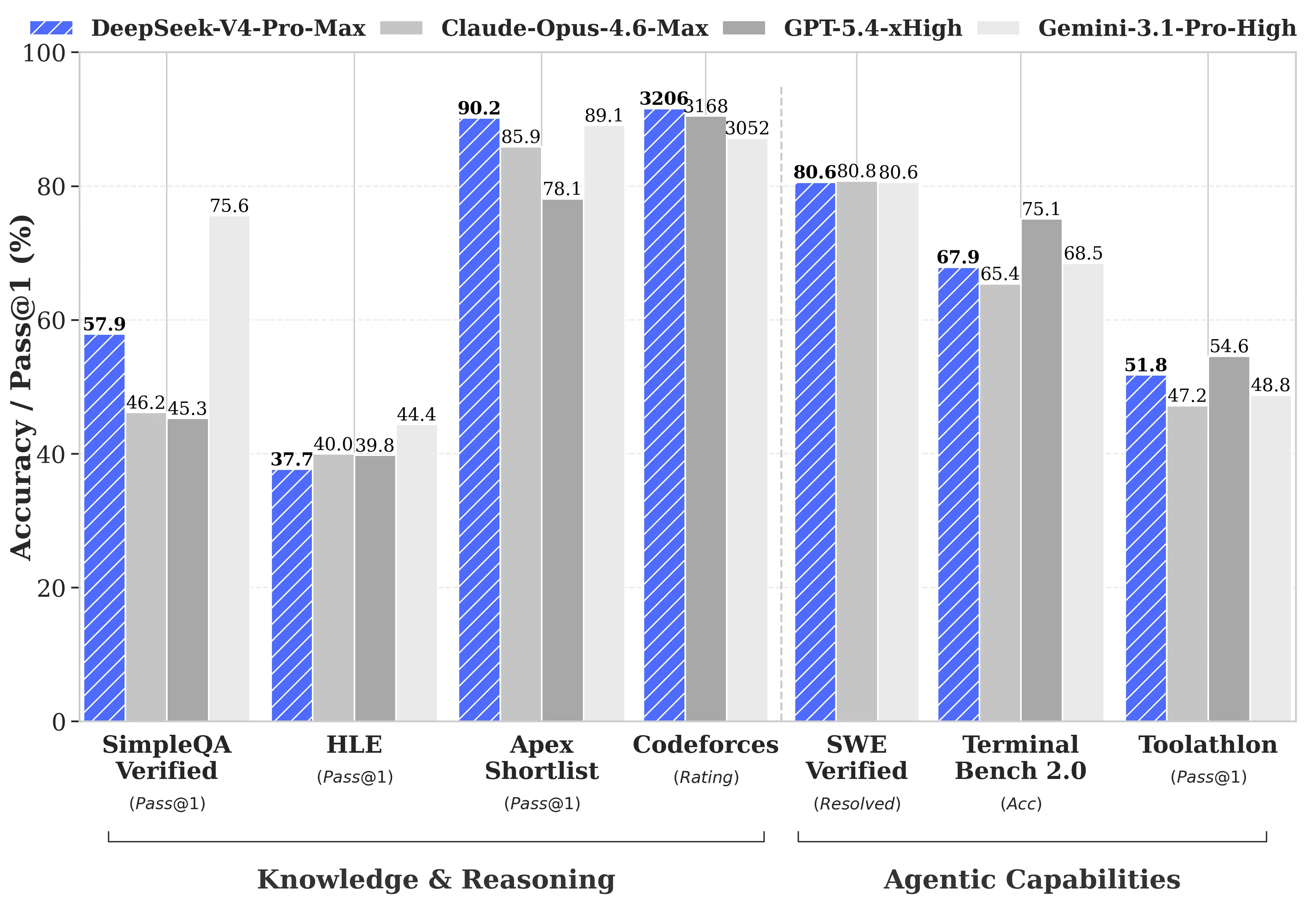

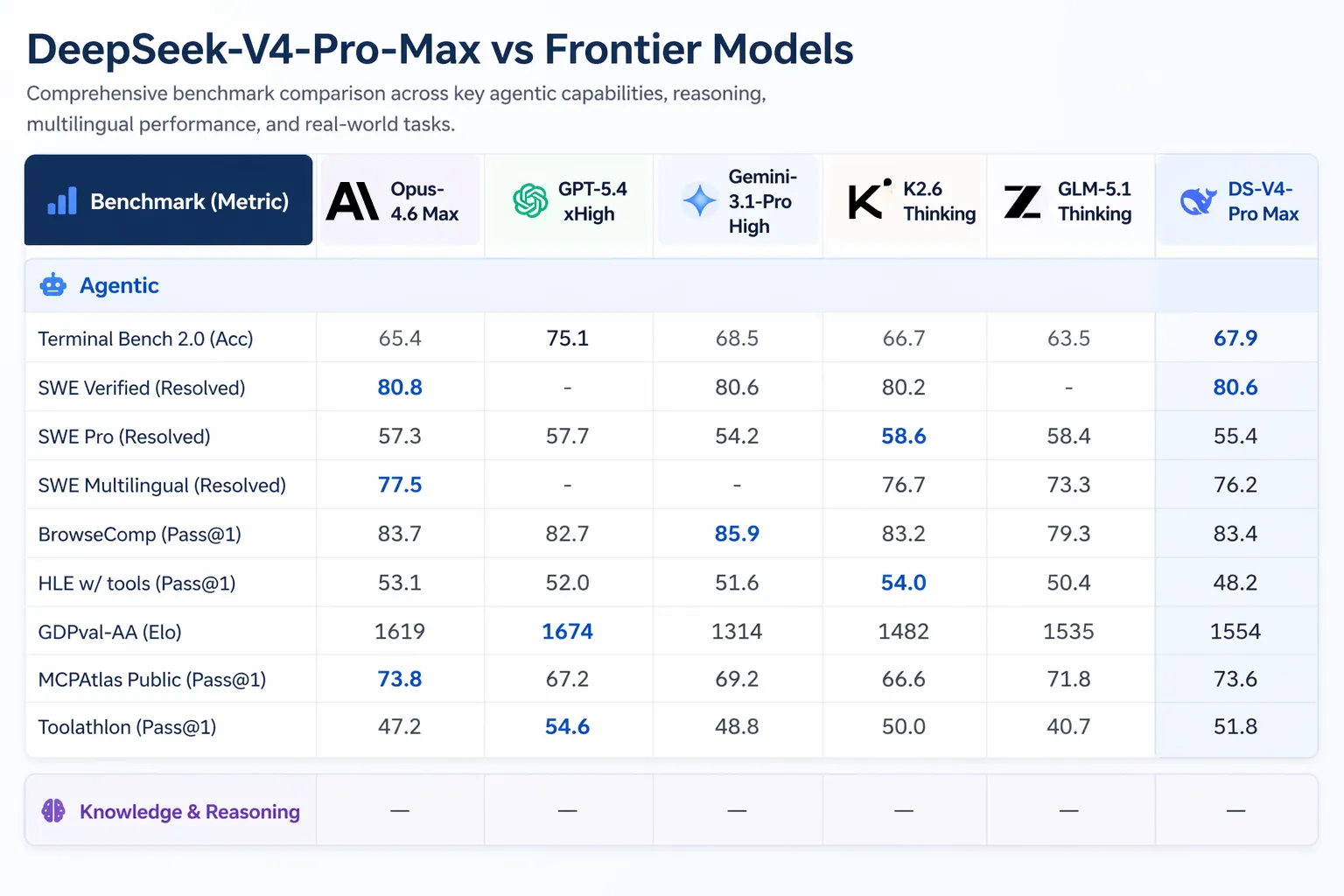

DeepSeek робить дещо незвичне у своєму технічному звіті: публікує прогалини. Більшість випусків моделей обирають бенчмарки, де вони перемагають. DeepSeek провела повне порівняння з GPT-5.4 та Gemini-3.1-Pro, виявила, що міркування V4-Pro відстають від цих моделей приблизно на три-шість місяців, і все одно надрукувала це.

Де V4-Pro-Max фактично перемагає: Codeforces, бенчмарк конкурентного програмування, що оцінюється подібно до людських шахів. V4-Pro набрав 3206 балів, посівши приблизно 23 місце серед реальних учасників змагань. На Apex Shortlist, курованому наборі складних математичних та STEM-завдань, він показав рівень успішності 90,2% порівняно з 85,9% у Opus 4.6 та 78,1% у GPT-5.4. На SWE-Verified, який вимірює, чи може модель вирішувати реальні проблеми GitHub, витягнуті з фактичних репозиторіїв з відкритим вихідним кодом, вона показала 80,6% — що відповідає Claude Opus 4.6.

Де вона відстає: бенчмарк багатозадачності MMLU-Pro (Gemini-3.1-Pro — 91,0% проти 87,5% у V4-Pro), бенчмарк експертних знань GPQA Diamond (Gemini — 94,3% проти 90,1% у V4-Pro) та Humanity’s Last Exam, бенчмарк рівня аспірантури, де 44,4% у Gemini-3.1-Pro все ще випереджають 37,7% у V4-Pro.

Щодо довгого контексту, V4-Pro випереджає моделі з відкритим вихідним кодом і обганяє Gemini-3.1-Pro на бенчмарку CorpusQA (тест, що імітує реальний аналіз документів з мільйоном токенів), але поступається Claude Opus 4.6 на MRCR — тесті, що вимірює, наскільки добре модель знаходить конкретні “голки” глибоко в “дуже довгому стозі сіна”.

Створено для роботи агентів, а не лише для відповідей на запитання

Аспект роботи з агентами є особливо цікавим для розробників, які створюють продукти.

V4-Pro може працювати з Claude Code, OpenCode та іншими інструментами для кодування ШІ. Згідно з внутрішнім опитуванням DeepSeek серед 85 розробників, які використовували V4-Pro як основного агента кодування, 52% заявили, що вона готова бути їхньою стандартною моделлю, 39% схилилися до “так”, і менше 9% відповіли “ні”. Внутрішні співробітники стверджують, що вона перевершує Claude Sonnet і наближається до Claude Opus 4.5 у завданнях кодування для агентів.

Artificial Analysis, яка проводить незалежні оцінки моделей ШІ на реальних завданнях, поставила V4-Pro на перше місце серед усіх моделей з відкритими вагами за показником GDPval-AA — бенчмарком, що тестує економічно цінну інтелектуальну роботу у сферах фінансів, права та досліджень, оціненою за системою Elo. V4-Pro-Max набрав 1554 Elo, випередивши GLM-5.1 (1535) і M2.7 від MiniMax (1514). Для порівняння, Claude Opus 4.6 набирає 1619 Elo за тим самим бенчмарком — все ще попереду, але розрив скорочується.

DeepSeek V4 Pro is the #1 open weights model on GDPval-AA, our agentic real-world work tasks evaluation@deepseek_ai has released V4 Pro (1.6T total / 49B active) and V4 Flash (284B total / 13B active). V4 is DeepSeek’s first new size since V3, with all intermediate models… pic.twitter.com/2kJWVrKQjF

— Artificial Analysis (@ArtificialAnlys) April 24, 2026

V4 від Deepseek також впроваджує так зване “чергування думок” (interleaved thinking). У попередніх моделях, якщо ви запускали агента, який робив кілька викликів інструментів — наприклад, шукав в Інтернеті, потім виконував якийсь код, потім знову шукав — контекст міркувань моделі скидався між раундами. На кожному новому кроці модель мала відновлювати свою ментальну модель з нуля. V4 зберігає повний ланцюжок думок між викликами інструментів, тому 20-кроковий робочий процес агента не страждає від амнезії в середині. Це має більше значення, ніж здається, для всіх, хто використовує складні автоматизовані конвеєри.

Deepseek та американо-китайська війна за ШІ

США обмежують експорт високопродуктивних чіпів Nvidia до Китаю з 2022 року. Заявлена мета — сповільнити розвиток ШІ в Китаї, але заборона на чіпи не зупинила DeepSeek, а навпаки, змусила їх винайти більш ефективну архітектуру та розвинути вітчизняне апаратне постачання.

DeepSeek не випускала V4 у вакуумі — AI-простір останнім часом кипить активністю: Anthropic випустила Claude Opus 4.7 16 квітня — модель, яку *Decrypt* тестував і знайшов потужною в кодуванні та міркуваннях, з помітно високим використанням токенів. За день до цього Anthropic також мала Claude Mythos, модель для кібербезпеки, яку, за їхніми словами, не можна випускати публічно, оскільки вона надто добре справляється з автономними мережевими атаками.

Xiaomi випустила MiMo V2.5 Pro 22 квітня, повністю мультимодальну — зображення, аудіо, відео. Вартість становить $1 за вхідні та $3 за вихідні мільйони токенів. Вона відповідає Opus 4.6 за більшістю бенчмарків кодування. Три місяці тому ніхто не говорив про Xiaomi як про передову AI-компанію. Тепер вона випускає конкурентоспроможні моделі швидше, ніж більшість західних лабораторій.

GPT-5.5 від OpenAI з’явився вчора, зі зростанням витрат до $180 за мільйон вихідних токенів у версії Pro. Він обганяє V4-Pro на Terminal Bench 2.0 (82,7% проти 70,0%), що тестує складні робочі процеси агентів у командному рядку. Але він значно дорожчий за V4-Pro для еквівалентних завдань. Того ж дня Tencent випустила Hy3, ще одну передову модель, зосереджену на ефективності.

Що це означає для вас

Отже, з такою кількістю нових моделей, розробники фактично ставлять питання: коли преміум-клас виправдовує себе?

Для підприємств математика могла змінитися. Модель, що лідирує в бенчмарках з відкритим вихідним кодом за ціною $1,74 за мільйон вхідних токенів, означає, що обробка великих обсягів документів, юридичний аналіз або конвеєри генерації коду, які були дорогими шість місяців тому, тепер значно дешевші. Мільйон токенів контексту дозволяє подавати цілі кодові бази або нормативні документи одним запитом замість того, щоб розбивати їх на кілька викликів.

Крім того, її відкритий характер означає, що її можна не тільки безкоштовно запускати на локальному обладнанні, але й налаштовувати та вдосконалювати відповідно до потреб та випадків використання компанії.

Для розробників та незалежних авторів V4-Flash — це те, на що варто звернути увагу. За $0,14 за вхідні та $0,28 за вихідні, вона дешевша за моделі, які рік тому вважалися бюджетними варіантами — і вона обробляє більшість завдань, які виконує версія Pro. Існуючі кінцеві точки deepseek-chat і deepseek-reasoner від DeepSeek вже маршрутизують до V4-Flash у режимах без роздумів та з роздумами відповідно, тож якщо ви використовуєте API, ви вже користуєтеся нею.

Наразі моделі працюють тільки з текстом. DeepSeek заявила, що працює над мультимодальними можливостями, що означає, що інші великі лабораторії, від Xiaomi до OpenAI, все ще мають перевагу в цій галузі. Обидві моделі мають ліцензію MIT і доступні на Hugging Face сьогодні. Старі кінцеві точки deepseek-chat і deepseek-reasoner будуть виведені з експлуатації 24 липня 2026 року.

Погляд Crypto Top: Впровадження DeepSeek V4-Pro з його революційною ефективністю та низькою вартістю може змінити динаміку ШІ-ландшафту Web3, роблячи потужні обчислення ШІ більш доступними. Це, ймовірно, стимулюватиме розвиток децентралізованих ШІ-мереж та збільшить корисність токенів, що використовуються для оплати цих обчислень.

Джерело: decrypt.co