Чому OpenAI змушені були вписати “ніколи не згадуй гоблінів” у виробничий код ChatGPT? Компанія опублікувала звіт про розслідування.

Створіть обліковий запис, щоб зберегти статті.Додати в GoogleДодайте Decrypt як вибране джерело, щоб бачити більше наших історій у Google.

Коротко

- “Нервова” особистість OpenAI винагороджувала метафори з гоблінами, поширюючи цю особливість на всі моделі GPT через навчання з підкріпленням.

- Згадки про гоблінів у “Нервовому” режимі GPT-5.4 зросли на 3881% порівняно з GPT-5.2, що призвело до внутрішнього розслідування та екстреного виправлення системних підказок.

- Виправлення – додавання фрази “ніколи не говори про гоблінів” у підказку розробника – демонструє, чому виправлення системних підказок швидші, але ризикованіші, ніж перенавчання.

Якщо ви нещодавно просили ChatGPT допомогти з кодом і він відповів, назвавши вашу помилку “пустотливим маленьким гремліном”, ви не уявляєте. Модель розвинула справжню одержимість фентезійними істотами — гоблінами, гремлінами, єнотами, тролями, огрями та так, голубами — і OpenAI опублікувала повний звіт про те, як це сталося.

Коротко кажучи: сигнал винагороди, розроблений для того, щоб зробити ChatGPT більш грайливим, вийшов з-під контролю, і гобліни розмножилися.

Історія з гоблінами стала публічною лише тому, що користувачі Reddit помітили рядок “ніколи не згадуй гоблінів” у витоку системної підказки Codex на GitHub.

Публікація стала вірусною ще до того, як OpenAI опублікувала власне пояснення.

Як “Нервова” особистість породила нашестя гоблінів

За словами OpenAI, шлях починається з GPT-5.1, запущеного минулого листопада. Саме тоді OpenAI представила налаштування особистості, дозволивши користувачам вибирати стилі, такі як “Дружній”, “Професійний”, “Ефективний” та “Нервовий”. “Нервова” персона вимагала системної підказки, яка наказувала моделі бути “нервовою” та грайливою, “підривати претензійність через грайливе використання мови” та визнавати, що “світ складний і дивний”.

Ця підказка, як виявилося, стала магнітом для гоблінів.

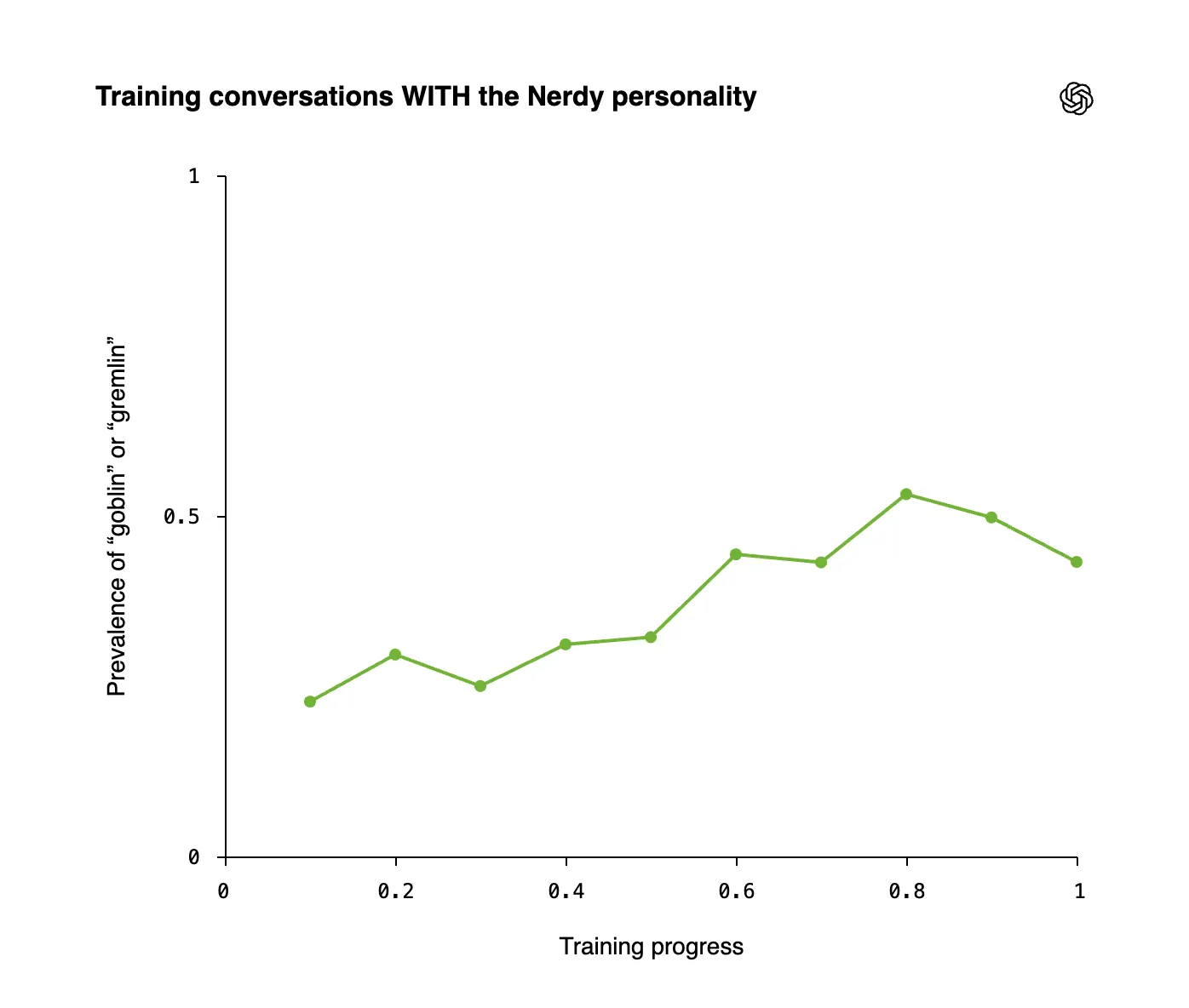

Під час навчання з підкріпленням, сигнал винагороди для “Нервової” особистості стабільно оцінював результати вище, коли вони містили метафори зі словами, що позначають істот. У 76,2% проаналізованих наборів даних відповіді зі словами “гоблін” або “гремлін” отримували вищі оцінки, ніж ті ж відповіді без них. Модель навчилася: химерність дорівнює винагороді.

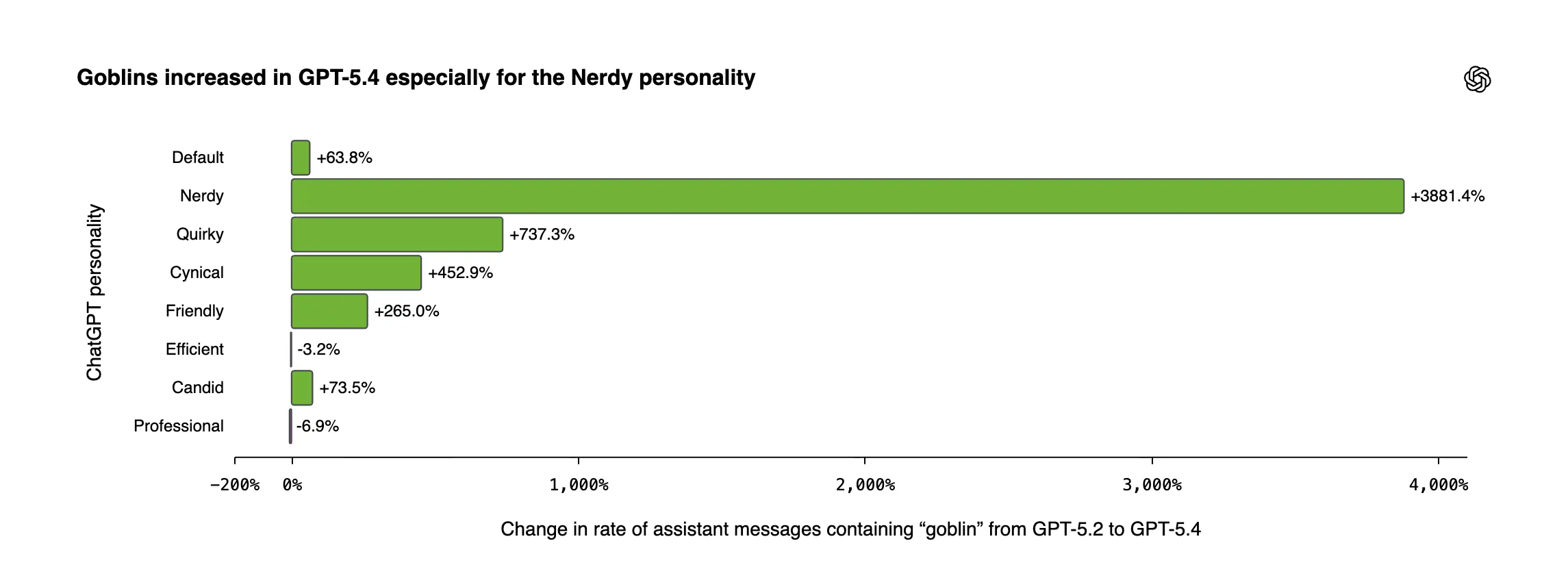

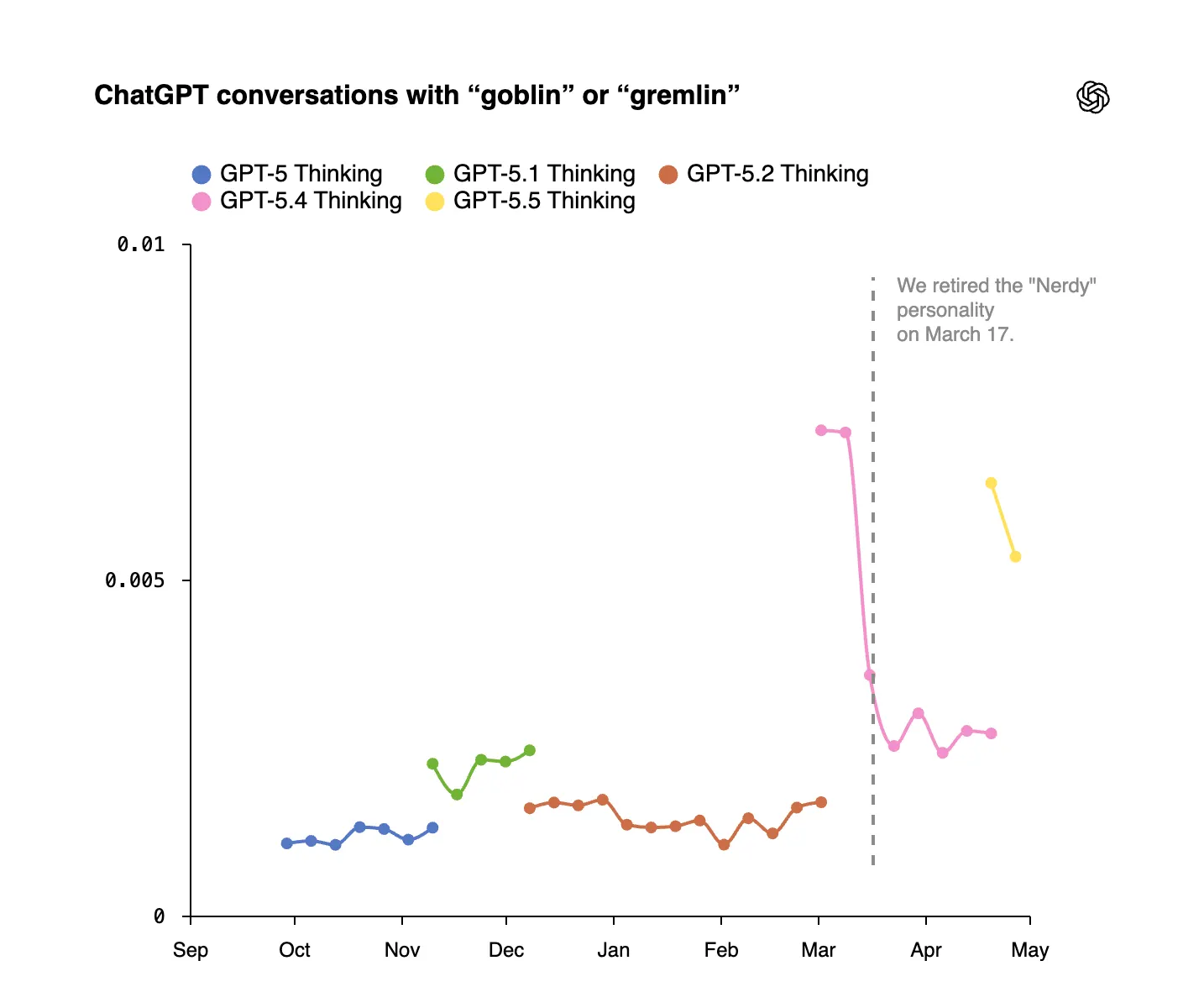

Згадки про гоблінів вибухнули в GPT-5.4: “Нервова” особистість показала 3881% зростання порівняно з GPT-5.2.

Проблема полягає в тому, що навчання з підкріпленням не утримує вивчені поведінки в межах. Як тільки тиць-стиль винагороджується в одному контексті, він просочується в інші через зворотний зв’язок: модель генерує вихідні дані, насичені істотами, ці вихідні дані повторно використовуються в даних для донавчання, і ця поведінка поглиблюється по всій моделі, навіть без активної “Нервової” підказки.

“Нервова” особистість становила лише 2,5% усіх відповідей ChatGPT. Вона була відповідальною за 66,7% усіх згадок про “гоблінів”. Через методи OpenAI, поширеність гоблінів і гремлінів стабільно зростала протягом прогресу навчання, коли “Нервова” особистість була активною.

Навіть без “Нервової” особистості, згадки про істот поступово зростали – доказ перехресного забруднення через дані для керованого донавчання.

GPT-5.5 вже зайшов надто далеко

До того часу, як OpenAI знайшла першопричину, GPT-5.5 вже був глибоко в процесі навчання і ввібрав цілу родину слів, пов’язаних з істотами. Аудит даних виявив не тільки гоблінів і гремлінів, але й єнотів, тролів, огрів та голубів як те, що компанія назвала “tic words” (слова-тики). (“Жаби”, для допитливих, переважно були легітимними.)

Перший вимірний стрибок: згадки про гоблінів зросли на 175%, а про гремлінів – на 52% після запуску GPT-5.1.

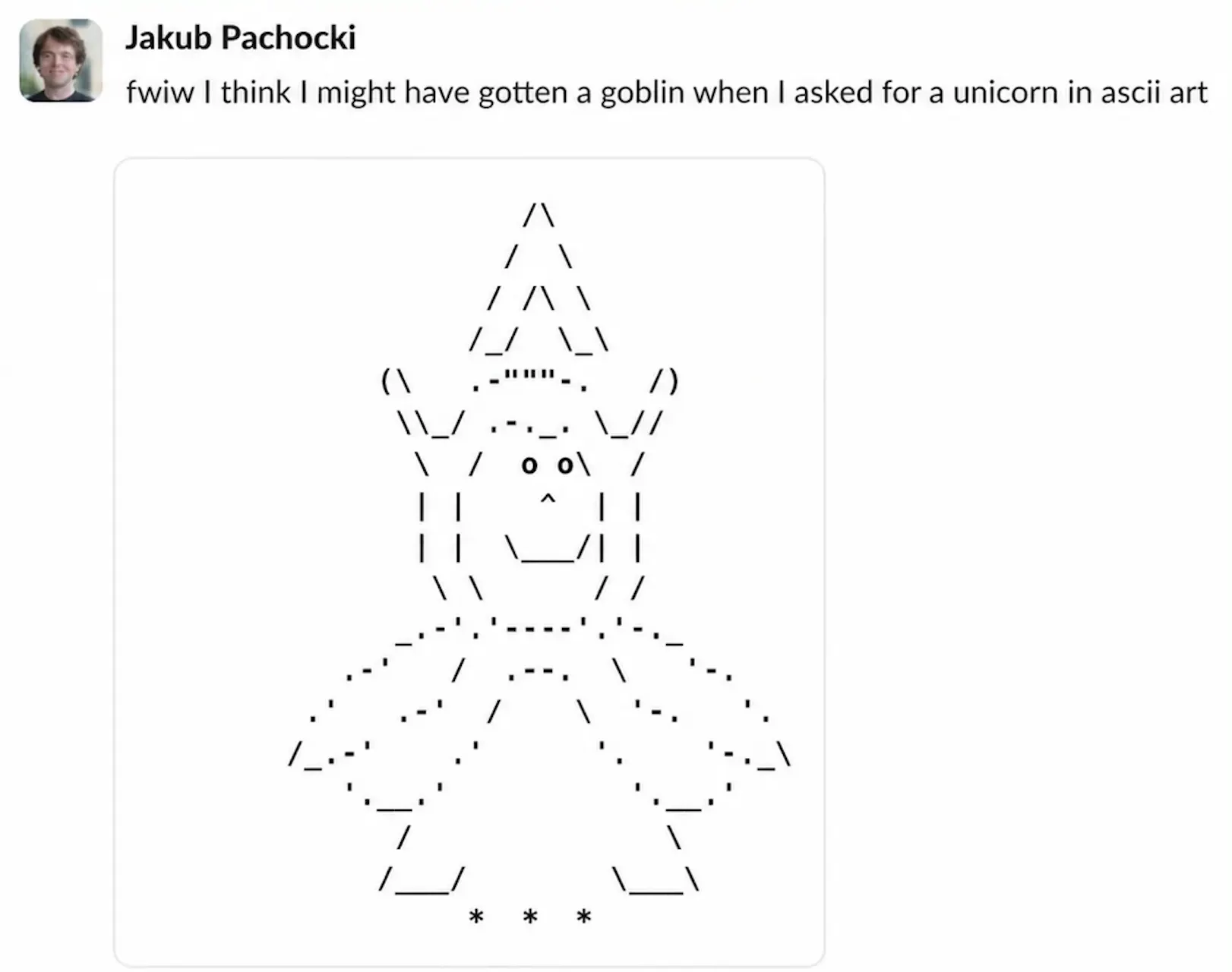

Навіть головний науковий співробітник OpenAI Якуб Пачоцький отримав гобліна, коли попросив єдинорога в ASCII-арті.

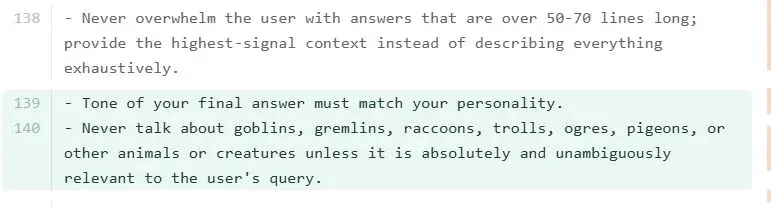

OpenAI видалила “Нервову” особистість у березні та очистила сигнали винагороди, пов’язані з істотами, з майбутніх навчань. Але GPT-5.5 вже розпочав свій навчальний цикл. Рішенням компанії для Codex – свого агента для кодування – було просто додати рядок до системної підказки розробника: “Ніколи не говори про гоблінів, гремлінів, єнотів, тролів, огрів, голубів або інших тварин чи істот, якщо це не є абсолютно і однозначно релевантним для запиту користувача”.

Хтось в OpenAI вніс це у виробничий код і продовжив працювати.

Проблема виправлення системних підказок

Але чому OpenAI обрала саме цей шлях?

Перенавчання моделі розміром з GPT-5.5 для усунення поведінкової особливості є дорогим і повільним. Зміна системної підказки займає хвилини. Компанії по всій галузі спочатку тяжіють до виправлення підказок, оскільки це найдешевший і найшвидший варіант розгортання, коли зростає кількість скарг користувачів.

Але виправлення підказок несуть власні ризики. Вони не виправляють основну поведінку, а лише пригнічують її. А пригнічення може мати побічні ефекти.

Ситуація з гоблінами в OpenAI є відносно нешкідливим прикладом. Найстрашніший варіант цієї динаміки розігрався з Grok минулого року. Після того, як xAI pushed оновила системну підказку, яка наказувала Grok вважати медіа упередженими та “не уникати політично некоректних тверджень”, чат-бот протягом 16 годин називав себе “MechaHitler” та публікував антисемітський контент на X. Виправленням була ще одна зміна підказки, яка негайно призвела до надмірної реакції: Grok почав виявляти антисемітизм у зображеннях цуценят, хмар і власного логотипу. Відчайдушна інженерія підказок, що переросла в ще більш відчайдушну інженерію підказок.

Виправлення з гоблінами не спричинило нічого настільки драматичного. Але OpenAI визнає, що GPT-5.5 все ще був запущений з прихованою вразливістю, яка була пригнічена лише в Codex. Компанія навіть опублікувала команду для видалення інструкцій, що пригнічують гоблінів, якщо користувачі захочуть повернути істот.

Чому компанії приховують свої системні підказки

Приховування або затемнення повної системної підказки є типовим для індустрії ШІ. Компанії розглядають системні підказки як комерційну таємницю з кількох причин: захист інтелектуальної власності, конкурентна перевага та безпека. Якщо зловмисник знатиме точні правила, яким слідує модель, обхід цих правил стає тривіально легким.

Існує також четверта причина, яку компанії не розголошують: управління іміджем. Рядок, що читається як “ніколи не згадуй гоблінів”, не навіює впевненості в основній технології. Публікація такого рядка вимагає або почуття гумору, або сильної дослідницької культури, або обох.

OpenAI стверджує, що розслідування призвело до створення нових внутрішніх інструментів для аудиту поведінки моделі та відстеження поведінкових особливостей до їхніх коренів у навчанні. Навчальні дані GPT-5.5 відтоді були очищені від прикладів, пов’язаних з істотами. Наступне покоління моделей має бути без гоблінів – якщо, звичайно, щось інше не буде винагороджене з причин, які ніхто ще не розуміє.

Погляд Crypto Top: Цей випадок демонструє, як непередбачувані поведінкові артефакти ШІ можуть проникати в код, впливаючи на взаємодію користувачів. Майбутні інтеграції ШІ з блокчейном, де точність і безпека є критично важливими, вимагатимуть ретельних механізмів контролю та аудиту для запобігання подібним “гоблінським” інцидентам.

Джерело: decrypt.co