Технологія, що зменшує потребу в пам’яті для запуску великих мовних моделей при зростанні контекстних вікон – ключове обмеження для розгортання ШІ.

Створіть обліковий запис, щоб зберегти свої статті.Додати в GoogleДодайте Decrypt як ваше пріоритетне джерело, щоб бачити більше наших історій у Google.

Коротко

- Google заявив, що його алгоритм TurboQuant може зменшити основний вузький пропуск пам’яті для ШІ щонайменше у шість разів без втрати точності під час інференсу.

- Акції виробників пам’яті, включаючи Micron, Western Digital та Seagate, впали після поширення цієї публікації.

- Метод стискає пам’ять для інференсу, а не ваги моделі, і був протестований лише на дослідницьких бенчмарках.

Google Research опублікував у середу TurboQuant – алгоритм стиснення, який зменшує основний вузький пропуск пам’яті для інференсу щонайменше в 6 разів, зберігаючи нульову втрату точності.

Робота має бути представлена на ICLR 2026, і реакція в мережі була миттєвою.

Генеральний директор Cloudflare Метью Принс назвав це “моментом DeepSeek” від Google. Ціни на акції виробників пам’яті, включаючи Micron, Western Digital та Seagate, того ж дня впали.

Чи це реально?

Ефективність квантизації – це саме по собі велике досягнення. Але “нульова втрата точності” потребує контексту.

TurboQuant націлений на KV-кеш – ділянку пам’яті GPU, яка зберігає все, що мовна модель повинна пам’ятати під час розмови.

Оскільки контекстні вікна зростають до мільйонів токенів, ці кеші роздуваються до сотень гігабайт на сесію. Це і є справжній вузький пропуск. Не обчислювальна потужність, а сира пам’ять.

Традиційні методи стиснення намагаються зменшити ці кеші, заокруглюючи числа вниз – наприклад, з 32-бітних чисел з плаваючою комою до 16, 8 або 4-бітних цілих. Щоб краще зрозуміти, уявіть стиснення зображення з 4K до Full HD, а потім до 720p. Легко сказати, що це те саме зображення в цілому, але в 4K роздільній здатності більше деталей.

Але є нюанс: вони повинні зберігати додаткові “квантизаційні константи” разом зі стисненими даними, щоб модель не “збожеволіла”. Ці константи додають 1-2 біти на значення, частково нівелюючи отримані вигоди.

TurboQuant стверджує, що усуває цей накладний витрат повністю.

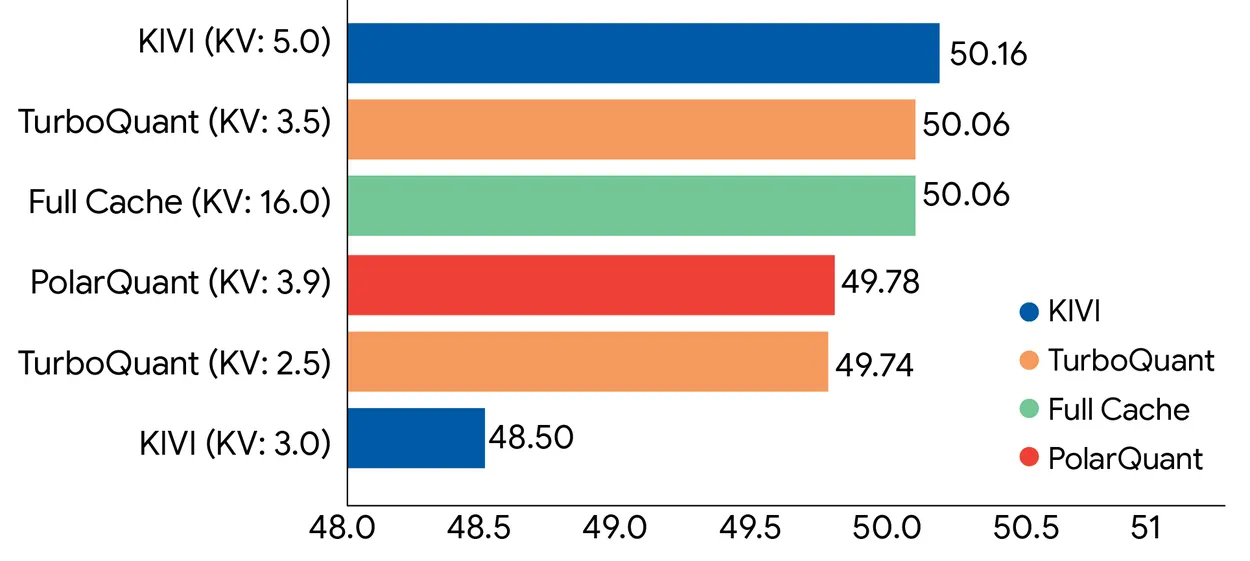

Це досягається за допомогою двох під-алгоритмів. PolarQuant відокремлює величину від напрямку у векторах, а QJL (Quantized Johnson-Lindenstrauss) бере залишковий мінімальний похибку і зводить її до одного знакового біта, позитивного чи негативного, без збереження констант.

Результатом, за словами Google, є математично незміщений оцінювач для розрахунків уваги, які керують трансформерними моделями.

У бенчмарках з використанням Gemma та Mistral, TurboQuant демонстрував продуктивність на рівні повної точності при 4-кратному стисненні, включаючи ідеальну точність вилучення даних у завданнях “голка в копиці сіна” до 104 000 токенів.

Щоб зрозуміти важливість цих бенчмарків, розширення доступного контексту моделі без втрати якості було однією з найскладніших проблем при розгортанні LLM.

Тепер про дрібний шрифт.

“Нульова втрата точності” стосується стиснення KV-кешу під час інференсу, а не ваг моделі. Стиснення ваг – це зовсім інша, складніша проблема. TurboQuant їх не торкається.

Він стискає тимчасову пам’ять, яка зберігає проміжні обчислення уваги під час сесії, що є більш прийнятним, оскільки ці дані теоретично можуть бути реконструйовані.

Існує також розрив між чистим бенчмарком та продакшн-системою, яка обслуговує мільярди запитів. TurboQuant тестувався на моделях з відкритим вихідним кодом – Gemma, Mistral, Llama – а не на власному стеці Gemini від Google у великих масштабах.

На відміну від ефективних покращень DeepSeek, які вимагали глибоких архітектурних рішень, закладених з самого початку, TurboQuant не потребує перенавчання чи доналаштування та стверджує про незначні накладні витрати під час виконання. Теоретично, він може бути легко інтегрований у існуючі конвеєри інференсу.

Саме це налякало виробників обладнання для пам’яті – адже якщо він буде працювати в продакшні, кожна велика лабораторія ШІ зможе ефективніше використовувати ті самі GPU, які вже має.

Публікація направляється на ICLR 2026. Доки технологія не буде впроваджена в продакшн, заголовок про “нульову втрату” залишається лабораторною реальністю.

Погляд Crypto Top: Ця технологія стиснення пам’яті може суттєво знизити бар’єри для розгортання складних ШІ-моделей на децентралізованих обчислювальних мережах, потенційно підвищуючи утилітарність токенів, що забезпечують ці ресурси.

Джерело: decrypt.co