Пентагонівська угода спричинила масовий відтік користувачів з ChatGPT — і вивела Claude від Anthropic на перше місце в App Store. Але головна історія ховається у формулюваннях контракту.

Створіть обліковий запис, щоб зберегти свої статті.Додати в GoogleДодайте Decrypt як бажане джерело, щоб бачити більше наших історій у Google.

Коротко

- OpenAI уклала угоду з Пентагоном про розгортання ШІ в закритих середовищах.

- Компанія заявила про встановлення “червоних ліній”, але контракт дозволяє “всі законні цілі” — стандарт, який зрештою залежить від власної інтерпретації уряду.

- Суперечка викликала рух “QuitGPT” та сплеск завантажень Claude.

OpenAI повідомила цими вихідними, що досягла угоди з Пентагоном про розгортання передових систем штучного інтелекту (ШІ) у закритих середовищах, що знаменує собою суттєве розширення роботи компанії з військовими США.

Це оголошення пролунало менш ніж за 24 години після того, як адміністрація Трампа внесла Anthropic до чорного списку, позначивши конкурента ШІ як “ризик для національної безпеки через ланцюг постачань” після суперечки щодо формулювань контракту, пов’язаних зі стеженням та автономною зброєю.

Президент Дональд Трамп також доручив федеральним агентствам негайно припинити використання технологій Anthropic, а міністр фінансів Скотт Бессент написав у понеділок у X, що відомство “припиняє все використання продуктів Anthropic, включаючи використання її платформи Claude, у нашому департаменті”.

"THE UNITED STATES OF AMERICA WILL NEVER ALLOW A RADICAL LEFT, WOKE COMPANY TO DICTATE HOW OUR GREAT MILITARY FIGHTS AND WINS WARS! That decision belongs to YOUR COMMANDER-IN-CHIEF, and the tremendous leaders I appoint to run our Military.

The Leftwing nut jobs at Anthropic… pic.twitter.com/aIEx92nnyx

— The White House (@WhiteHouse) February 27, 2026

Час оголошень щодо ШІ поставив угоду OpenAI під пильну увагу. У детальному пості в блозі компанія виклала те, що вона описала як тверді “червоні лінії” та багатошарові запобіжники, що регулюють її партнерство з Пентагоном.

Угода, як її представила OpenAI, порушує ширші питання щодо того, як будуть регулюватися системи ШІ в умовах національної безпеки, і як заявлені компанією обмеження будуть інтерпретуватися та виконуватися на практиці.

Коли «законно» недостатньо

У своєму пості в блозі OpenAI починає з трьох зобов’язань, сформульованих як непорушні: жодного використання її технологій для масового внутрішнього стеження, незалежного керування автономною зброєю або прийняття рішень у критично важливих сферах, таких як соціальний рейтинг.

Далі йдуть формулювання самого контракту — яке OpenAI помітно називає “відповідним формулюванням”, а не “повною угодою”.

«Міністерство війни може використовувати систему ШІ для всіх законних цілей, відповідно до чинного законодавства, оперативних вимог та встановлених протоколів безпеки та нагляду», — заявила OpenAI.

Це саме те формулювання, якого, за словами Anthropic, вимагав уряд протягом переговорів. Точне формулювання, з яким Anthropic не погодилася. OpenAI підписала його, але стверджує, що її “червоні лінії” залишаються повністю недоторканими.

Проте, “законний” у контексті національної безпеки — це не фіксована межа; він існує в межах сукупності законів, виконавчих указів, внутрішніх директив і часто секретних правових тлумачень. Коли контракт надає дозвіл на “всі законні цілі”, практична межа стає поточним правовим полем уряду, а не незалежним стандартом, встановленим постачальником.

Кластер пунктів

Пункт про зброю говорить, що система ШІ “не буде використовуватися для самостійного наведення автономної зброї у будь-якому випадку, коли закон, нормативний акт або політика департаменту вимагають людського контролю”.

Заборона застосовується лише там, де інший орган вже вимагає людського контролю — вона повністю спирається на існуючу політику, зокрема Директиву Міністерства оборони 3000.09. Ця директива вимагає, щоб автономні системи дозволяли командирам здійснювати “відповідні рівні людського судження щодо застосування сили”.

А “відповідний” — це надзвичайно суб’єктивне поняття.

Людське *судження* — це не людський контроль. Ця відмінність не була випадковою. Дослідники в галузі оборони зазначали, що виключення мови “людина в циклі” було навмисним, саме для збереження операційної гнучкості.

Найсильнішим контраргументом OpenAI є її хмарна архітектура розгортання — повністю автономні цикли прийняття летальних рішень вимагатимуть розгортання на польових пристроях, що ця угода не дозволяє. Це реальне технічне обмеження.

Але хмарний ШІ все ще може виконувати ідентифікацію цілей, аналіз патернів життєдіяльності та планування місій. Це все діяльність у ланцюгу знищення, незалежно від того, де знаходиться остаточний тригер. Результат для цілі не змінюється залежно від того, на якому сервері працює модель.

Пункт про стеження йде тим самим шляхом. Заявлена “червона лінія” OpenAI: жодного масового внутрішнього стеження. Формулювання контракту: система “не повинна використовуватися для необмеженого моніторингу приватної інформації осіб США, що узгоджується з цими повноваженнями” — далі перераховуються Четверта поправка, FISA та Виконавчий указ 12333.

Слово “необмежений” передбачає, що обмежена форма масового стеження буде допустимою. А Вказ 12333 — це виконавчий указ, який АНБ використовувало для обґрунтування перехоплення комунікацій американців, коли це відбувалося за межами кордонів США.

І тут стає помітною стурбованість Anthropic формулюваннями протягом переговорів. Аргумент Anthropic полягав у тому, що чинне законодавство не встигає за тим, що стало можливим завдяки ШІ. Уряд може законно придбати величезні обсяги агрегованих комерційних даних про американців без ордера — і вже робив це.

Формулювання контракту OpenAI, прив’язуючи свої захисти до чинних правових рамок, може не закрити прогалину, про яку насправді турбувалася Anthropic.

Альтернативна відповідь

У суботу ввечері Альтман провів сесію запитань і відповідей, відповідаючи на тисячі запитань про угоду. Коли його запитали, що змусить OpenAI відмовитися від партнерства з урядом, він відповів: “Якщо нас попросять зробити щось неконституційне чи незаконне, ми підемо”.

If we were asked to do something unconstitutional or illegal, we will walk away. Please come visit me in jail if necessary.

— Sam Altman (@sama) March 1, 2026

Таке формулювання ставить межу OpenAI на рівні законності — а не незалежного етичного судження про те, що компанія дозволить або не дозволить, якщо це виявиться законним, що захищає Anthropic. На запитання, чи хвилюється він щодо майбутніх суперечок щодо того, що вважається “законним”, він визнав ризик: “Якщо нам доведеться вступити в цю боротьбу, ми це зробимо, але це явно наражає нас на певний ризик”.

Щодо того, чому OpenAI досягла угоди, яку не змогла отримати Anthropic, Альтман запропонував таке: “Anthropic, здавалося, більше зосереджувалася на конкретних заборонах у контракті, аніж на посиланні на чинні закони, з чим ми почувалися комфортно. Я, безумовно, віддав би перевагу технічним засобам захисту, якби мав обирати лише одне. Я думаю, Anthropic хотіла більше операційного контролю, ніж ми”.

Це суттєва філософська відмінність. Anthropic стверджувала, що оскільки передові моделі можуть бути перепрофільовані для інтелектуальних і військових робочих процесів способами, які важко передбачити, обмеження мають бути явними та обов’язковими в письмовій формі, навіть ціною угоди. Позиція OpenAI полягає в тому, що технічна архітектура, вбудований персонал та чинне законодавство разом становлять сильніший захист, ніж сам контрактний текст.

Громадськість обрала сторону

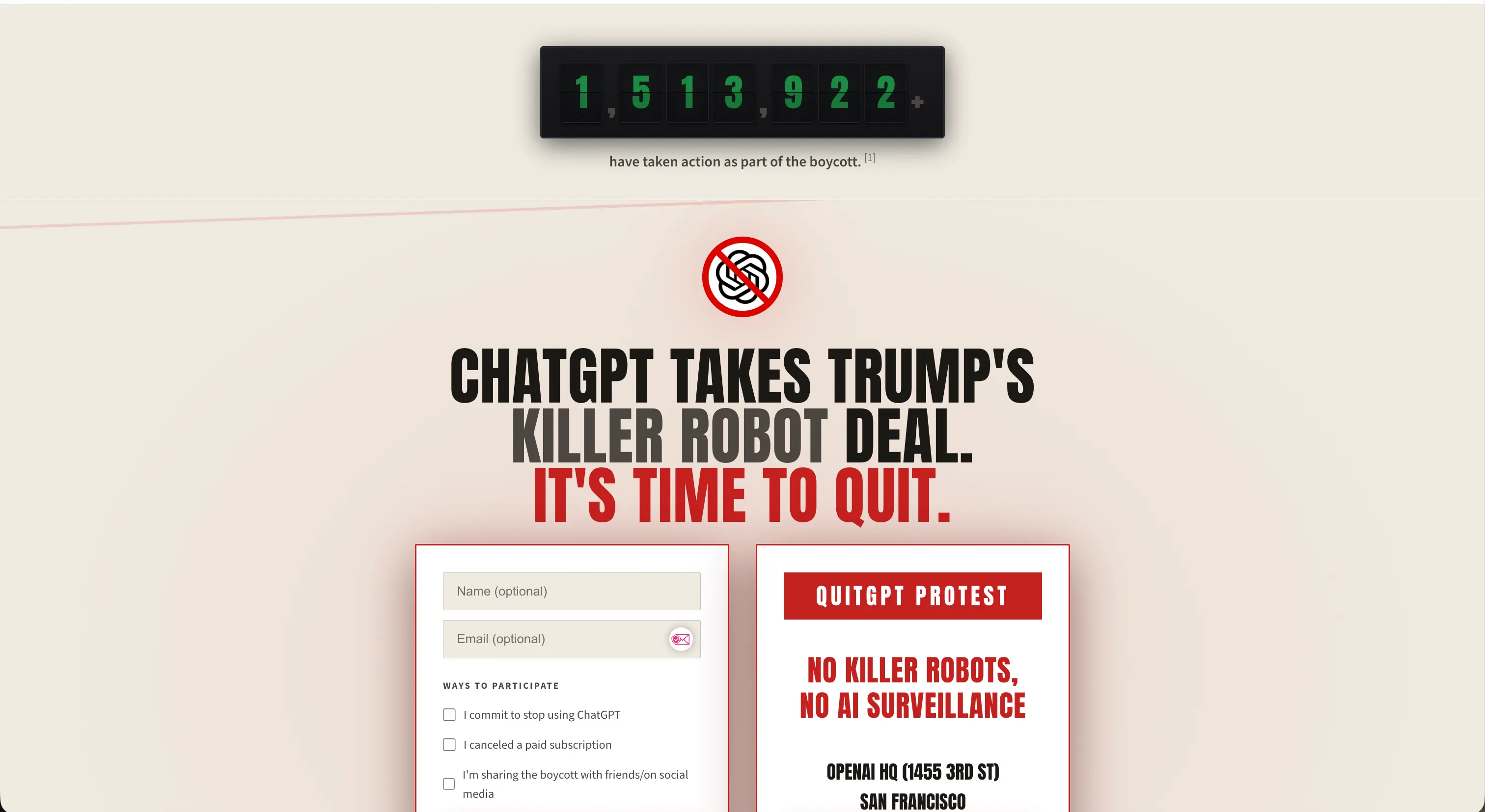

Реакція була миттєвою. До понеділка рух “QuitGPT” заявив, що понад 1,5 мільйона людей вжили заходів — скасували підписки, поширили пости про бойкот або зареєструвалися на quitgpt.org.

Кампанія представила дії OpenAI як пріоритет військових контрактів над безпекою користувачів, звинувативши компанію в згоді дозволити Пентагону використовувати свої технології для “будь-яких законних цілей, включаючи роботи-вбивці та масове стеження”.

OpenAI може заперечувати таку характеристику. Але ринок рухався незалежно.

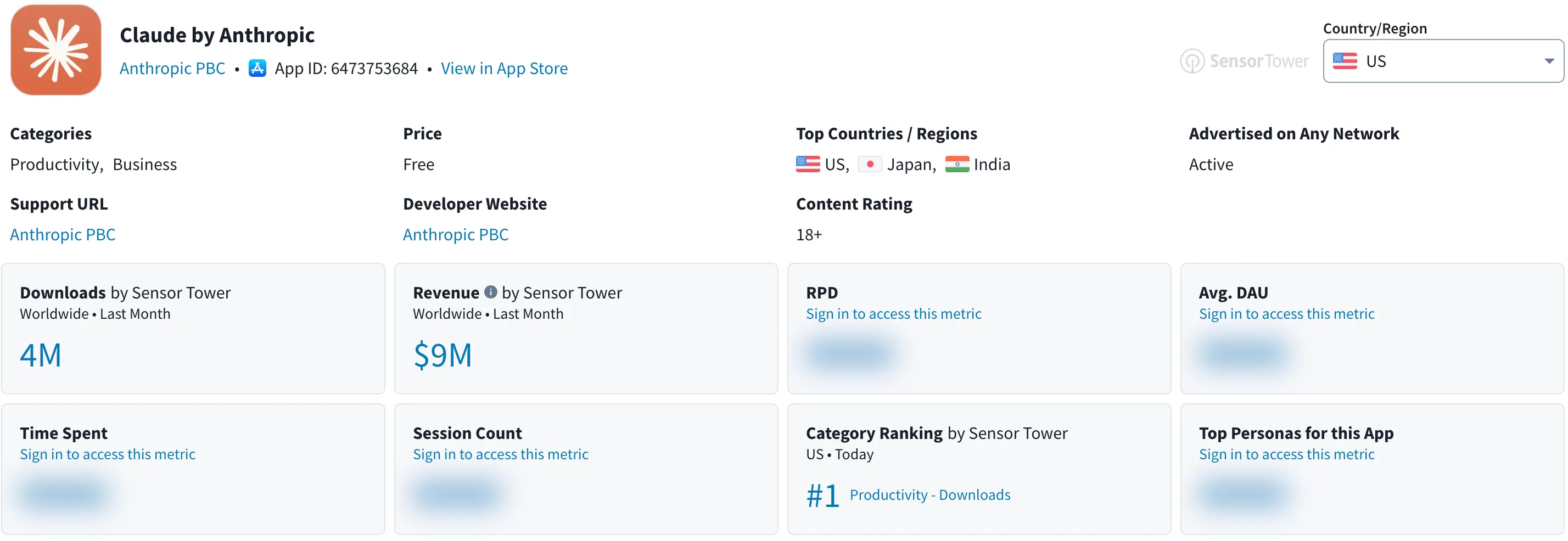

Claude від Anthropic обігнав ChatGPT і став найзавантажуванішим безкоштовним додатком у США в App Store від Apple. Компанія повідомила Decrypt, що за вихідні отримала рекордну кількість щоденних реєстрацій.

Поп-зірка Кеті Перрі опублікувала знімок сторінки з цінами Claude в X. Сотні користувачів публічно документували скасування своїх підписок на Reddit. Графіті на підтримку Anthropic з’явилося біля її офісів у Сан-Франциско, а тротуари OpenAI були засипані крейдою. Навіть сотні власних співробітників OpenAI раніше підписали відкритий лист на підтримку відмови Anthropic підкоритися вимогам Пентагону.

Формулювання “QuitGPT” є емоційно переконливим, але не зовсім точним. Сама Anthropic має партнерство з Palantir та Amazon Web Services, яке надає агенціям розвідки та оборонним департаментам США доступ до моделей Claude, і, як стверджується, використовувалося в військових операціях для повалення урядів Венесуели та Ірану. Етика ШІ та контракти щодо національної безпеки ніколи не були однозначними з жодного боку.

Те, що кампанія точно відобразила, — це те, що велика частина користувачів вірила у значну різницю між тим, як дві компанії окреслили свої межі, і проголосувала своїми підписками.

Чи є ця різниця настільки значущою, як здається, вимагає уважного прочитання контракту.

Погляд Crypto Top: Угода OpenAI з Пентагоном підкреслює зростаючу роль ШІ у військових технологіях, що може призвести до зростання попиту на децентралізовані обчислювальні потужності для тренування та розгортання моделей, що, у свою чергу, може стимулювати розвиток ШІ-орієнтованих блокчейн-проектів, таких як Fetch.ai (FET) та SingularityNET (AGIX).

Джерело: decrypt.co