Tencent представила Hy3 preview: революційна модель ШІ з фокусом на кодинг-агентів та ефективність.

Створіть обліковий запис, щоб зберегти статті.Додати в GoogleДодайте Decrypt як улюблене джерело, щоб бачити більше наших історій у Google.

Коротко

- Hy3 preview — це модель “суміш експертів” (Mixture-of-Experts) з 295 мільярдами параметрів, з яких активними є лише 21 мільярд, що робить її економічнішою у використанні порівняно з конкурентами аналогічної потужності.

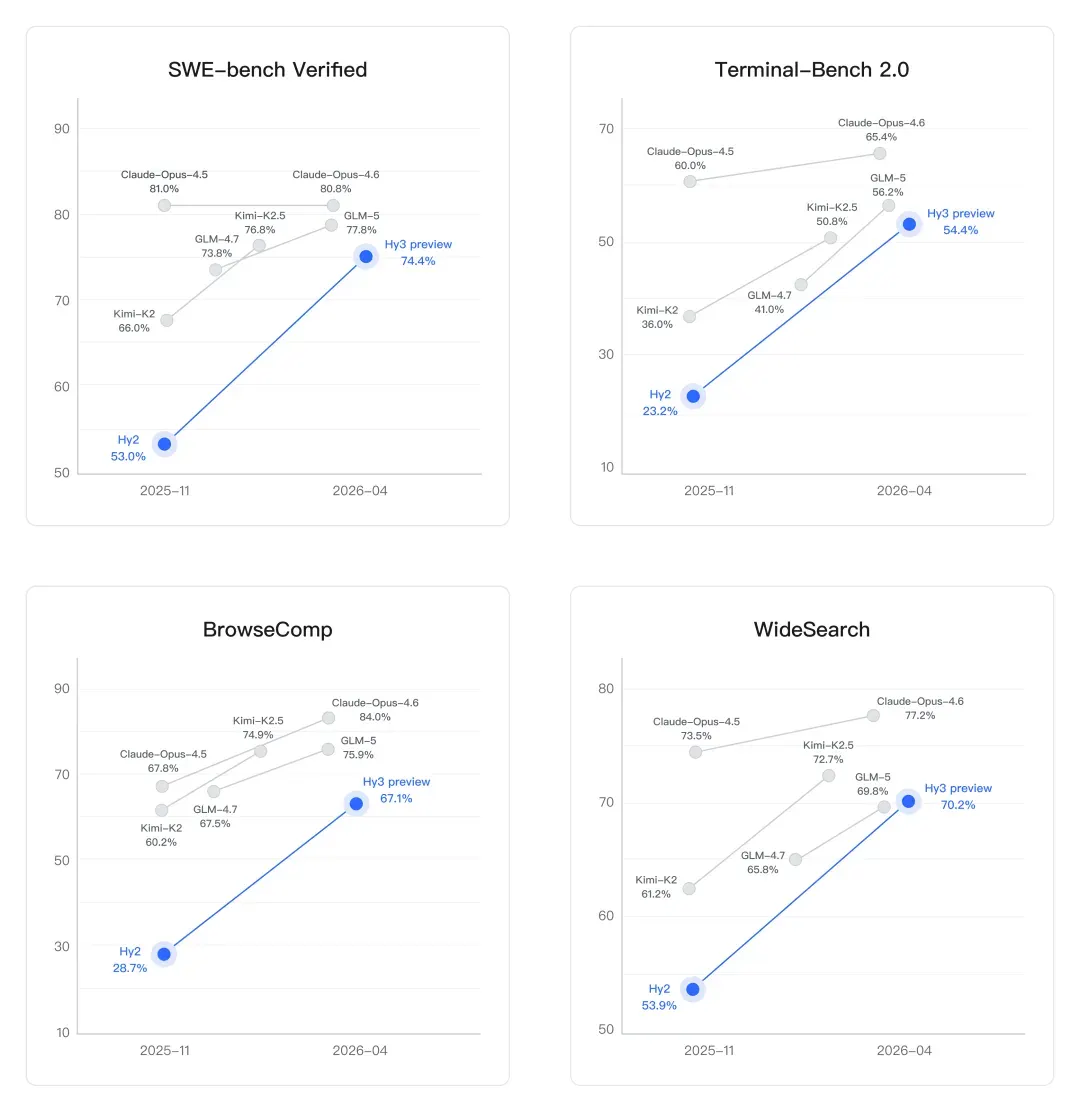

- На бенчмарку SWE-bench Verified, який тестує реальні виправлення помилок у GitHub, показник покращився з 53% (Hy2) до 74.4%, що на 40% краще за попереднє покоління.

- Модель вже інтегрована в екосистему додатків Tencent, включно з Yuanbao, QQ та Tencent Docs. Доступ через API на Tencent Cloud коштує приблизно $0.18 за мільйон вхідних токенів.

Компанія Tencent тихо випустила свою найпотужнішу на сьогодні модель штучного інтелекту (ШІ) у четвер. Результати бенчмарків вражають. Hy3 preview, перша модель компанії після повного оновлення інфраструктури, стала відкритою (open-source) на платформах GitHub, Hugging Face та ModelScope.

Модель також доступна на офіційному сайті Tencent Cloud за платною підпискою.

Hy3 містить 295 мільярдів загальних параметрів (показник потенційної широти знань моделі), але лише 21 мільярд активних у будь-який момент часу. Це перевага архітектури “суміш експертів” (Mixture-of-Experts): модель спрямовує кожен запит до спеціалізованої підмножини своїх “експертних” підмереж, а не обробляє все одночасно. Це вимагає менше обчислювальних ресурсів, знижує витрати та забезпечує приблизно таку ж якість виведення. Крім того, модель підтримує контекст до 256 000 токенів, що достатньо для обробки цілого роману в одному запиті.

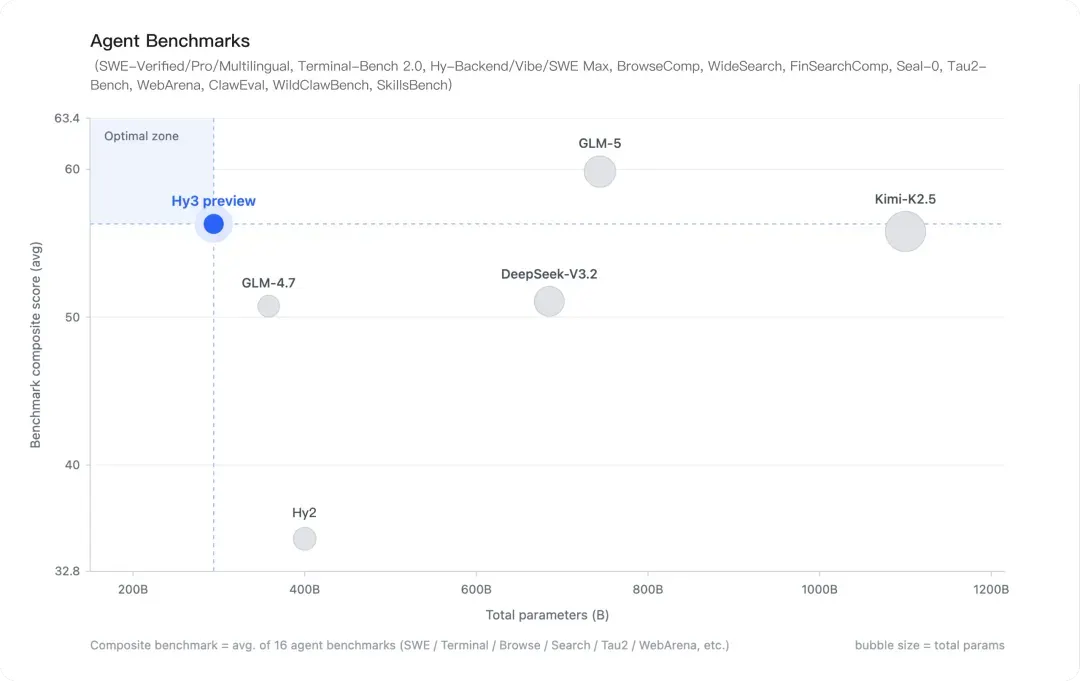

Модель розроблялася з метою балансування трьох аспектів, якими, за словами Tencent, раніше жертвували: широта можливостей, чесна оцінка та економічна ефективність. Попередній флагман, Hy2, мав понад 400 мільярдів параметрів. Tencent свідомо зменшив це число, стверджуючи, що 295 мільярдів є оптимальною точкою, де міркування повністю розвиваються, але витрати на додавання нових параметрів перестають бути виправданими.

Це не означає, що модель стала гіршою. Моделі з кращим навчанням та меншою кількістю параметрів часто перевершують більші загальні моделі.

Прогрес у сфері кодування є драматичним. SWE-bench Verified — це бенчмарк, який перевіряє, чи може модель фактично виправляти реальні помилки в репозиторіях GitHub, а не іграшкові проблеми, а реальний продакшн-код. Hy2 набрав 53.0%. Hy3 preview показує 74.4%. Це 40% стрибок за одне покоління, що ставить її в один ряд з Claude Opus 4.6 (80.8%) та вище за GLM-5 (77.8%) і Kimi-K2.5 (76.8%). Terminal-Bench 2.0, що вимірює виконання автономних завдань у реальному командному рядку, покращився з 23.2% до 54.4% — також величезний прогрес.

Однак, ця модель може бути надзвичайно цікавою для розробників, які працюють з ШІ-агентами. Агенти мають складний набір інструкцій, що включають пам’ять, навички та виклики інструментів. Часто вони щось упускають, що може зіпсувати робочий процес або призвести до незадовільних результатів. Тому можливості агентів стають все більш важливими для розробників ШІ, оскільки ця сфера стає найпопулярнішою в індустрії. Саме тому модель негайно стала доступною на Openclaw.

We're now live on @openclaw https://t.co/yfytwvZSe6

— Tencent Hy (@TencentHunyuan) April 23, 2026

Пошукові та браузерні агенти — де моделі повинні отримувати, фільтрувати та синтезувати інформацію з відкритого Інтернету без людського втручання — також значно покращилися. На бенчмарку BrowseComp, який відстежує складні завдання веб-досліджень, Hy3 preview досягла 67.1% (з 28.7% у Hy2). На WideSearch вона показала 70.2%, перевершивши GLM-5 та Kimi-K2.5, але поступаючись Claude Opus 4.6 (77.2%).

У сфері міркувань модель перевершила всіх китайських конкурентів на вступному іспиті до аспірантури з математики Університету Цінхуа (весна 2026 року), показавши середній результат 88.4 з трьох прогонів (avg@3). Це реальний іспит, а не відібраний набір даних — саме такий тип оцінки, на якому Tencent наголошує, щоб уникнути маніпуляцій з бенчмарками. Модель також показала 87.8 на CHSBO 2025 (національна китайська олімпіада з біології для старшокласників), найвищий показник серед китайських моделей у цій категорії.

Навчання Hy3 preview розпочалося наприкінці січня 2026 року, а запуск відбувся у четвер — менш ніж за три місяці від початку до випуску з відкритим кодом. Це незвично швидко для передової моделі. Tencent пояснює це оновленням інфраструктури у лютому під керівництвом Яо Шунью, головного наукового співробітника з ШІ, який наполіг на повному переробленні стека попереднього навчання та навчання з підкріпленням.

Це суттєво відрізняється від підходів китайських лабораторій ШІ рік тому, коли R1 від DeepSeek вразив індустрію своєю економічною ефективністю.

Hy3 все ще поступається флагманським моделям OpenAI та Google DeepMind, але з точки зору співвідношення розміру та продуктивності, Hy3 preview важко ігнорувати: композитний показник бенчмарку агентів показує її в “оптимальній зоні” з приблизно 295 мільярдами параметрів, випереджаючи DeepSeek-V3.2 (понад 600 мільярдів) і відповідаючи Kimi-K2.5 (понад 1 трильйон параметрів) при частці витрат на обчислення.

Моделі Hunyuan вже розгорнуті в Yuanbao, CodeBuddy, WorkBuddy, QQ та Tencent Docs. На CodeBuddy та WorkBuddy затримка першого токена зменшилася на 54%, час генерації від початку до кінця скоротився на 47%, а модель успішно виконала робочі процеси агентів довжиною до 495 кроків. Tencent Cloud пропонує доступ до API приблизно за $0.18 за мільйон вхідних токенів та $0.59 за мільйон вихідних токенів, з індивідуальними пакетами Token Plan, що стартують приблизно від $4.10 на місяць.

Погляд Crypto Top: Випуск Hy3 preview як моделі з відкритим кодом, що демонструє високу ефективність у кодуванні та роботі агентів, значно розширює можливості для децентралізованих ШІ-проектів. Це може призвести до зростання попиту на токени, що керують такими децентралізованими обчислювальними мережами, як FET або TAO, оскільки розробники шукатимуть ефективніші ШІ-рішення.

Джерело: decrypt.co